近两年的人工智能和深度学习为各个行业带来了革命性的变化,而能够负载这些技术的一般只有GPU硬件,选择合适的GPU可以极大地影响工作流程。本文将对目前用于AI和深度学习的六个最强大的GPU进行详细对比,同时匹配最优商家服器推荐,仅供参考。

1、NVIDIA RTX 4090

- 架构:Ada Lovelace

- 发布日期:2022 年 10 月

- 计算能力:8.9

- CUDA 核心:16,384 个

- Tensor 核心:512 个(第四代)

- 显存:24 GB GDDR6X

- 显存带宽:1.01 TB/s

- 单精度浮点运算性能:82.6 TFLOPS

- 半精度浮点运算性能:165.2 TFLOPS

- Tensor 核心性能:330 TFLOPS (FP16),660 TOPS (INT8)

RTX 4090主要面向游戏,打在Ada Lovelace架构和24 GB显存,对于尝试深度学习模型的开发者而言是一款性价比极高的选择。同时在人工智能任务方面也展现出了强大的实力,适用于中小型项目。然而,其面向消费者的设计缺乏企业级功能,例如 ECC 内存。

NVIDIA RTX 4090服务器推荐:

Lightlayer(直达官网):提供美国达拉斯和新加坡机房的NVIDIA RTX 4090 GPU服务器,采用128核的高性能CPU,起步10G不限流量,内存512G起步,支持SSD和NVME存储。Lightlayer特点是性能较高、定价较高,月付价格$2569起。除此之外还提供了GPU虚拟机和CPU集群控制面板VPS。

HostEase(直达官网):NVIDIA RTX 4090 GPU服务器位于美国犹他州、新泽西和纽约等机房,显存带宽不限制,搭载AMD Ryzen和Intel i9系列CPU,NVMe Gen4和NVMe SSD硬盘支持,起步价格$650起。可以根据自己的需求选择相应的大小。

RAKsmart(直达官网):RAKsmart GPU服务器位于美国硅谷和中国香港,具备更强的性能和更高的扩展能力,其中AMD7702P*2方案搭载4090*8显卡,1024G内存、2*1T SSD硬盘和100M带宽,无流量限制,官方定价$11379,联系客户获得更低折扣。

2、NVIDIA RTX 5090- 架构:Blackwell 2.0

- 发布日期:2025 年 1 月

- 计算能力:10.0

- CUDA 核心:21,760

- Tensor 核心:680 个(第五代)

- 显存:32 GB GDDR7

- 内存带宽:1.79 TB/s

- 单精度浮点运算性能:104.8 TFLOPS

- 半精度浮点运算性能:104.8 TFLOPS

- Tensor 核心性能:450 TFLOPS (FP16),900 TOPS (INT8)

备受期待的 RTX 5090 采用了 Blackwell 2.0 架构,配备了更多的 CUDA 核心和更快的 GDDR7 显存,性能较其前代产品有了显著提升。RTX 5090非常适合处理要求更高的 AI 工作负载。虽然尚未在企业环境中广泛应用,但其卓越的性价比使其成为研究人员和开发人员的有力竞争者。

NVIDIA RTX 5090服务器推荐:

HostEase(直达官网):HostEase RTX 5090 GPU服务器位于美国犹他州数据中心,端口速度高达10G,内存采用最新硬件96GB DDR5,并搭配3.84TB NVME Gen4硬盘。RTX4090 GPU服务器支持犹他州、新泽西、纽约、达拉斯机房,可提供单卡、双卡和八卡配置,可选不限流量和50T流量。目前定价较低,50T/10G配置价格低至$699。

Database Mart(直达官网):专注于美国GPU服务器、GPU VPS和GPU云服务器,20年稳定自营机房,支持RTX 5090美国服务器和VPS,每月价格$319.20起,超高性价比。配置方面搭载96GB内存、32核、400GB SSD和500Mbps带宽(不限流量),活动期间购买更划算。

3、NVIDIA RTX A6000- 架构:Ampere

- 发布日期:2021 年 4 月

- 计算能力:8.6

- CUDA 核心:10,752

- Tensor 核心:336(第三代)

- 显存:48 GB GDDR6

- 显存带宽:768 GB/s

- 单精度浮点运算性能:38.7 TFLOPS

- 半精度浮点运算性能:77.4 TFLOPS

- Tensor 核心性能:312 TFLOPS (FP16)

RTX A6000 是一款工作站级高性能显卡,配备 48 GB 大容量显存和 ECC 纠错功能,适合训练大型模型。虽然其 Ampere 架构相比 Ada 和 Blackwell 架构而言较为老旧,但对于需要在生产环境中保持稳定性和可靠性的专业人士来说仍然是首选。

NVIDIA RTX A6000服务器推荐:

Database Mart(直达官网):作为GPU大户,Database Mart NVIDIA RTX A6000配置的服务器自然少不了,不过定价较NVIDIA RTX 5090有所提升(最低409美元),性价比依然很高。配置方面最低搭载256GB内存、双18核E5-2697v4处理器、240GB固态硬盘 + 2TB NVMe + 8TB SATA存储、100Mbps带宽(1G流量)。

4、NVIDIA RTX 6000 Ada- 架构:Ada Lovelace

- 发布日期:2022 年 12 月

- 计算能力:8.9

- CUDA 核心:18,176 个

- Tensor 核心:568 个(第四代)

- 显存:48 GB GDDR6 ECC

- 内存带宽:960 GB/s

- 单精度浮点运算性能:91.1 TFLOPS

- 半精度浮点运算性能:91.1 TFLOPS

- Tensor 核心性能:1457.0 FP8 TFLOPS

RTX 6000 Ada 融合了 Ada Lovelace 架构的优势和企业级特性,包括 ECC 内存,专为前沿 AI 任务而设计,例如基础模型微调和大规模推理。其高效的功耗和卓越的性能使其成为高端专业应用的理想之选。

NVIDIA RTX 6000 Ada服务器推荐:

DigitalOcean(直达官网):专业提供国外GPU云服务器(官网为“GPU Droplet”),今年五月份新增了对NVIDIA RTX 6000 Ada GeneratiON GPU的支持目前已在其美国和加拿大多伦多机房可用。配备的48GB GDDR6显存,效率比H.264高出40%,分辨率提升至1440p。8核CPU、64G内存500 GiB NVMe低至$1.89/小时。

DigitalOcean优惠码:SWIM60START(新用户注册即可获得200美元的赠金,有效期60天)

5、NVIDIA Tesla A100- 架构:Ampere

- 发布日期:2020 年 5 月

- 计算能力:8.0

- CUDA 核心:6,912

- Tensor 核心:432(第三代)

- 显存:40/80 GB HBM2e

- 内存带宽:1,935 GB/s / 2,039 GB/s

- 单精度浮点运算性能:19.5 TFLOPS

- 双精度浮点运算性能:9.7 TFLOPS

- Tensor 核心性能:FP64 19.5 TFLOPS,Float 32 156 TFLOPS,BFLOAT16 312 TFLOPS,FP16 312 TFLOPS,INT8 624 TOPS

Tesla A100 专为数据中心打造,在大型 AI 训练和高性能计算 (HPC) 任务中表现出色。其多实例 GPU (MIG) 功能允许将 GPU 划分为多个小型 GPU,使其具有极高的灵活性。 A100 的 HBM2e 内存确保了无法比拟的内存带宽,是训练大规模 AI 模型的不二之选。

NVIDIA Tesla A100服务器推荐:

RAKsmart(直达官网):RAKsmart GPU服务器配置丰富,包括NVIDIA HGX A100 8-GPU SXM显卡,起步配置2048 GB内存、8*3.84 TB NVME硬盘、25G大带宽和15TB流量,支持DDoS防御,定价为每月$332000,联系客户获得最低折扣。

6、NVIDIA L40s- 架构:Ada Lovelace

- 发布日期:2022 年 10 月

- 计算能力:8.9

- CUDA 核心:18,176 个

- Tensor 核心:568 个(第四代)

- 显存:48 GB GDDR6 ECC

- 显存带宽:864GB/s

- 单精度浮点运算性能:91.6 TFLOPS

- 半精度浮点运算性能:91.6 TFLOPS

- Tensor 核心性能:INT4 TOPS 733,INT8 TOPS 733,FP8 733 TFLOPS,FP16 362.05 TFLOPS,BFLOAT16 362.05 TFLOPS,TF32 183 TFLOPS

NVIDIA L40s 是一款企业级 GPU,专为人工智能、图形和渲染任务方面设计。其 Ada Lovelace 架构和 ECC 内存为人工智能训练和部署提供了更加便捷的方式。性能与效率平衡,L40s 非常适合云部署和混合环境。

NVIDIA L40s服务器推荐:

DigitalOcean(直达官网):今年五月份DigitalOcean同样新增了NVIDIA L40S GPU,最多可配备8个L40S Tensor Core GPU,有第四代NVIDIA Tensor Core、第三代NVIDIA RT核心以及DLSS 3.0技术,除此之外,带有DigitalOcean的国外GPU云服务器还能让用户访问完整的DigitalOcean产品堆栈,其中就包括其GenAI平台和Kubernetes服务。

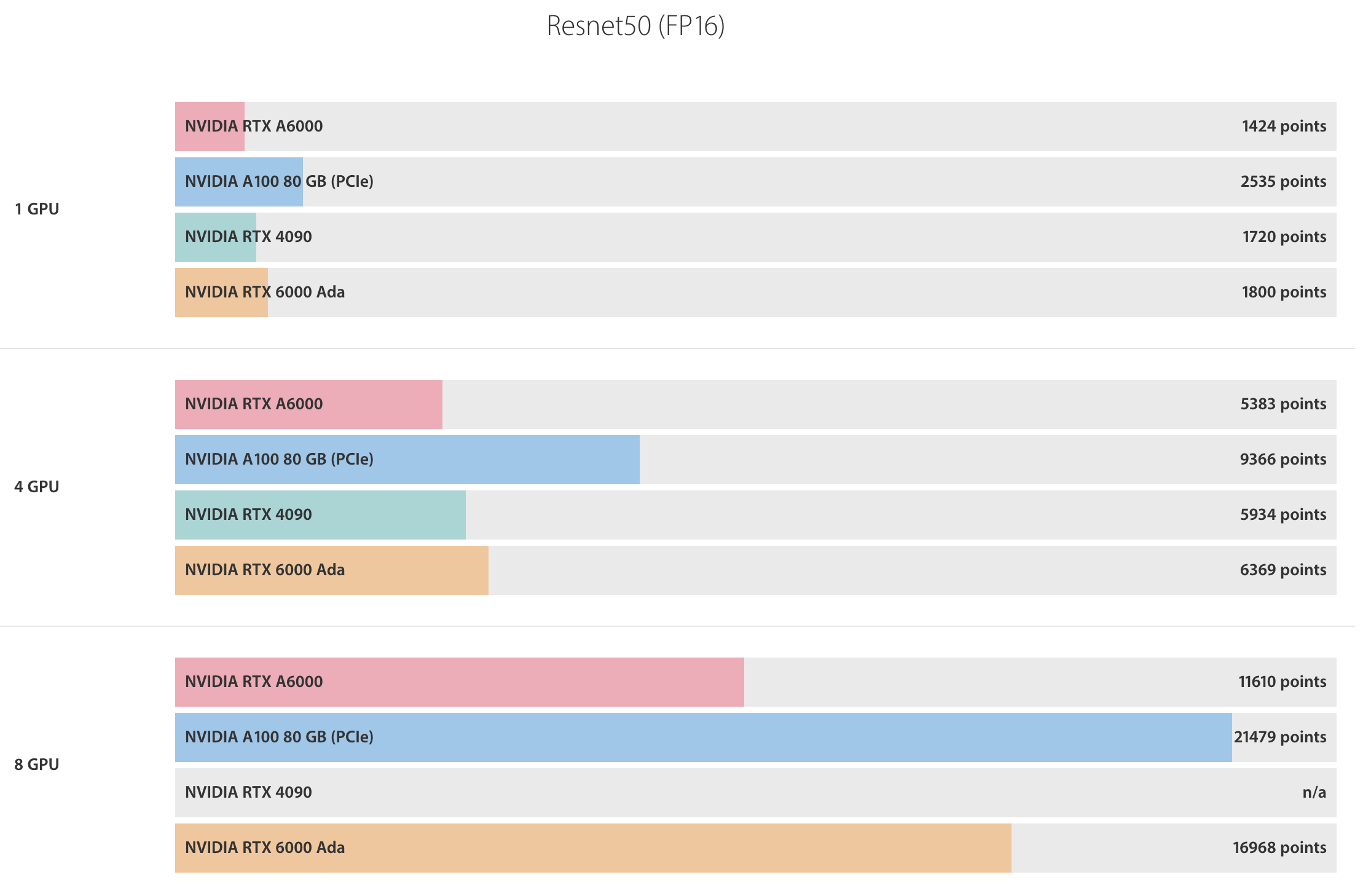

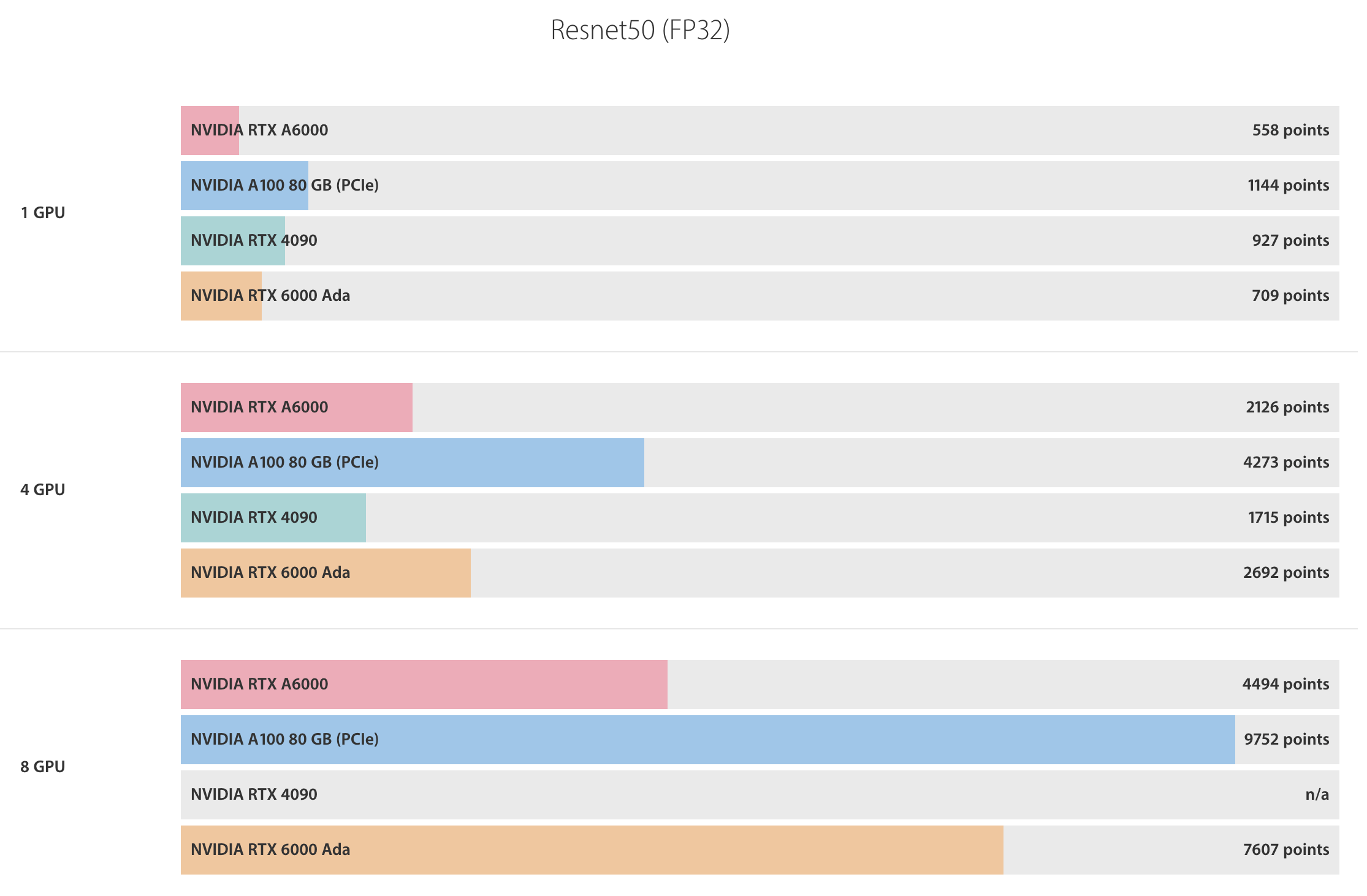

深度学习GPU基准测试2024-2025

相关阅读:

(本文由美国主机侦探原创,转载请注明出处“美国主机侦探”和原文地址!)

微信扫码加好友进群

主机优惠码及时掌握

QQ群号:164393063

主机优惠发布与交流