H100服务器是用于AI训练和推理最通用和部署最广泛的服务器,帮助商家在性能、兼容性和成本之间实现了稳固的平衡。目前市场上不少国外服务器租用商家都提供H100服务器,例如Lightlayer H100服务器租赁价格在每月九千美元或者一万美元左右。

一、H100是什么

H100是英伟达2022年推出的基于新 Hopper 架构的数据中心产品,具有 800 亿个晶体管和两种类型的内核,采用行业领先的 4 纳米制造工艺构建。

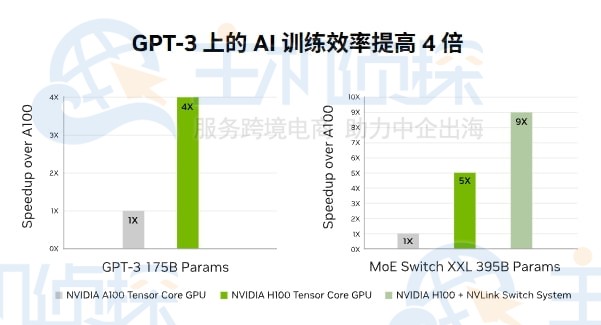

与上一代A100相比,AI 训练速度提高 4 倍,AI 推理速度提高 30 倍,有 50MB 的 2 级缓存和 80GB 的 HBM3 内存,带宽也是前代产品的两倍,达到 3 TB/秒。

在 GPU 虚拟化方面,每个 H100 都采用“无共享”方法被分割成多达七个隔离的实例,使其成为第一个原生支持机密计算的多实例 GPU,即能够保护使用中的数据,不仅仅是在存储或传输期间。

对于显着加快医疗保健、机器人、量子计算和数据科学等领域的动态规划算法发挥了重要作用,并且AI和HPC工作负载任务可以轻松从H100显卡中受益,提供了比 A100 更快的性能和更低的成本。

二、H100服务器租赁价格H100服务器采用H100显卡,例如Lightlayer提供拥有8个H100 Tensor Core GPU的H100服务器,每个H100 GPU都有多个第四代NVLink端口,并连接到所有的四个NVSwitch。每个NVSwitch都是一个完全无阻塞的开关,可以完全连接所有八个H100 Tensor Core GPU。

Lightlayer H100服务器可以保障通信以每秒 900 GB (GB/s) 的 NVLink 双向速度运行,是当前 PCIe Gen4 x16 总线带宽的 14 倍多,提高了硬件加速速度,并且显着降低了 GPU 的负载。

点击访问:Lightlayer官网 | Lightlayer优惠码

| 数据中心 | GPU | CPU | 内存 | 硬盘 | 带宽 | 价格/月 | 产品链接 |

| 达拉斯 | H100*8 | INTEL XEON 8462Y*2 | 1TB | 19.2T NVME | 10Gbps标准 | $10,512 | 立即购买 |

| 西雅图 | H100*8 | INTEL XEON 8462Y*2 | 1TB | 19.2T NVME | 10Gbps标准 | $10,512 | 立即购买 |

| 弗尼吉亚洲 | H100*8 | INTEL XEON 8462Y*2 | 1TB | 19.2T NVME | 10Gbps标准 | $10,512 | 立即购买 |

| 日本 | H100*8 | INTEL XEON 8460Y*2 | 2TB | 19.2T NVME | 1Gbps标准 | $9,344 | 立即购买 |

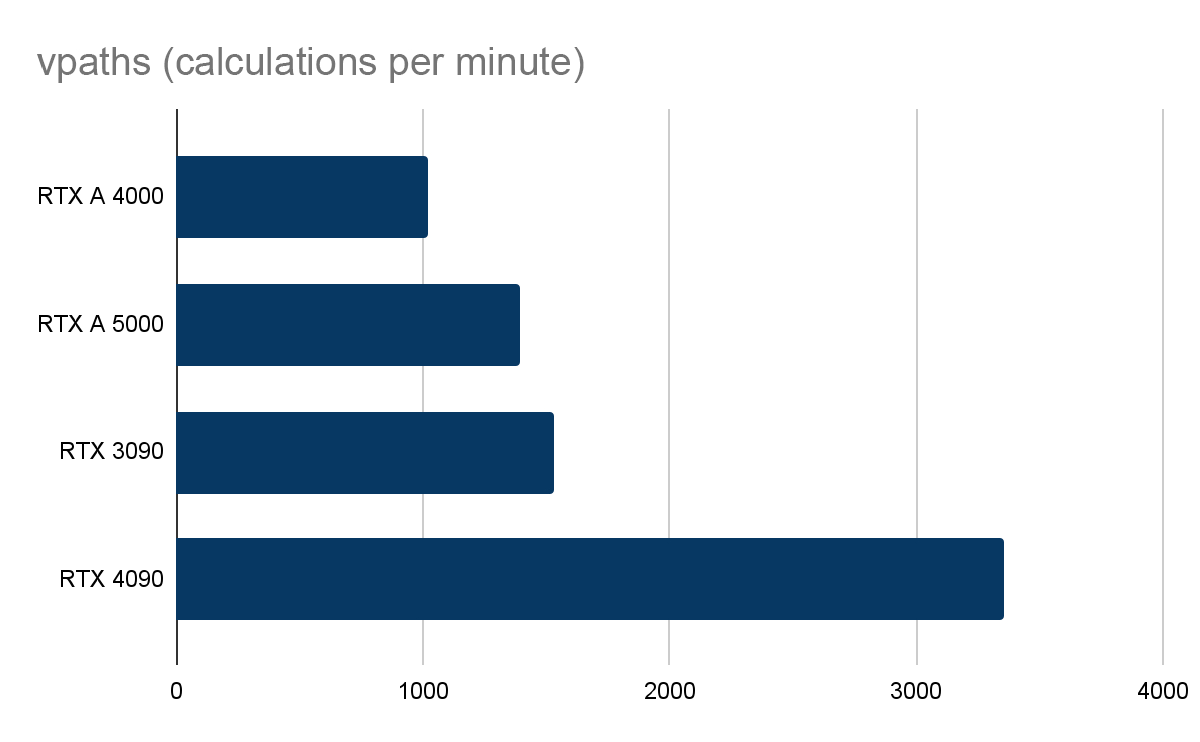

不过这里提醒大家注意的一点是,虽然H100服务器提供了不错的GPU渲染效果,但是具有更通用GPU系统性能的RTX 4090服务器通常会更好,这也侧面反映了H100在计算任务而不是图形任务方面的突出优势。

| 数据中心 | GPU | CPU | 内存 | 硬盘 | 带宽 | 价格/月 | 产品链接 |

| 达拉斯 | RTX4090*8 | INTEL XEON P8136*2 | 512G | 7.68T SSD*2+960G SSD*2 | 10G国际 | $2,920 | 立即购买 |

| 达拉斯 | RTX4090*8 | AMD EPYC 7702*2 | 512G | 2T SSD | 10G国际 | $3,179.56 | 立即购买 |

| 达拉斯 | RTX4090*8 | AMD EPYC 7763*2 | 512G | 960G SSD*2 | 10G国际 | $3,439.11 | 立即购买 |

| 新加坡 | RTX 4090×8 | AMD EPYC 7763×2 | 2 TB | SSD 500G (RAID1)+NVME 7T×4 | 1G国际 | $3,180 | 立即购买 |

总的来说,H100服务器是企业和专业人士在苛刻环境中优先考虑 AI 优化、计算任务和可靠性的绝佳选择。其独特的NVIDIA Hopper架构设计和Transformer引擎为 AI 驱动的工作负载提供了灵活性和性能。配备RTX 4090显卡的GPU服务器可能更适合专注于传统 GPU 渲染的用户。

推荐阅读:

(本文由美国主机侦探原创,转载请注明出处“美国主机侦探”和原文地址!)

微信扫码加好友进群

主机优惠码及时掌握

QQ群号:164393063

主机优惠发布与交流