近日亚马逊云科技(AWS)宣布正式推出由NVIDIA B200提供支持的“Amazon EC2 P6-B200”GPU云服务器实例,可加速各种支持GPU的工作负载,适用于人工智能(AI)、机器学习(ML)和高性能计算(HPC)等高需求场景。Amazon EC2 P6-B200实例目前已在美国西部(俄勒冈州)区域推出,可以作为适用于ML的EC2容量块购买。

亚马逊云科技官网:点击直达(自即日起至2026年12月31日,免费试用由AWS Graviton2处理器驱动的Amazon EC2 t4g.small实例,每月最高可使用750小时)

Amazon EC2 P6实例由NVIDIA Blackwell和Blackwell Ultra GPU加速,是大中型训练和推理应用程序的理想选择。与用于人工智能训练和推理的P5en实例相比,P6-B200实例的性能提高到多达2倍,而P6-B300实例为大规模人工智能训练和推理提供了高性能,这些实例非常适合复杂的模型,例如混合专家(MoE)模型和具有数万亿参数的推理模型。

P6-B200实例中的每个NVIDIA Blackwell GPU都采用第二代Transformer Engine,并支持新的精度格式,例如FP4。它支持第五代NVLink,这是一种更快、更宽的互连,可以为每个GPU提供高达1.8 TBp/s的带宽。

Amazon EC2 P6-B200实例规格:

新的Amazon EC2 P6-B200实例提供八个NVIDIA B200 GPU、1440 GB的高带宽GPU内存、第五代英特尔至强可扩展处理器(Emerald Rapids)、2 TiB的系统内存和30 TB的本地NVMe存储。与P5en实例相比,这些实例的GPU TFLOP最多可提高125%,GPU内存大小增加了27%,GPU内存带宽增加了60%。

以下是Amazon EC2 P6-B200实例的规格:

| 实例大小 | GPU(NVIDIA B200) | GPU | vCPU | GPU 点对点(GB/s) | 实例存储(TB) | 网络带宽(Gbps) | EBS 带宽(Gbps) |

| P6-b200.48xlarge | 8 | 1440 HBM3e | 192 | 1800 | 8 x 3.84 NVMe SSD | 8 x 400 | 100 |

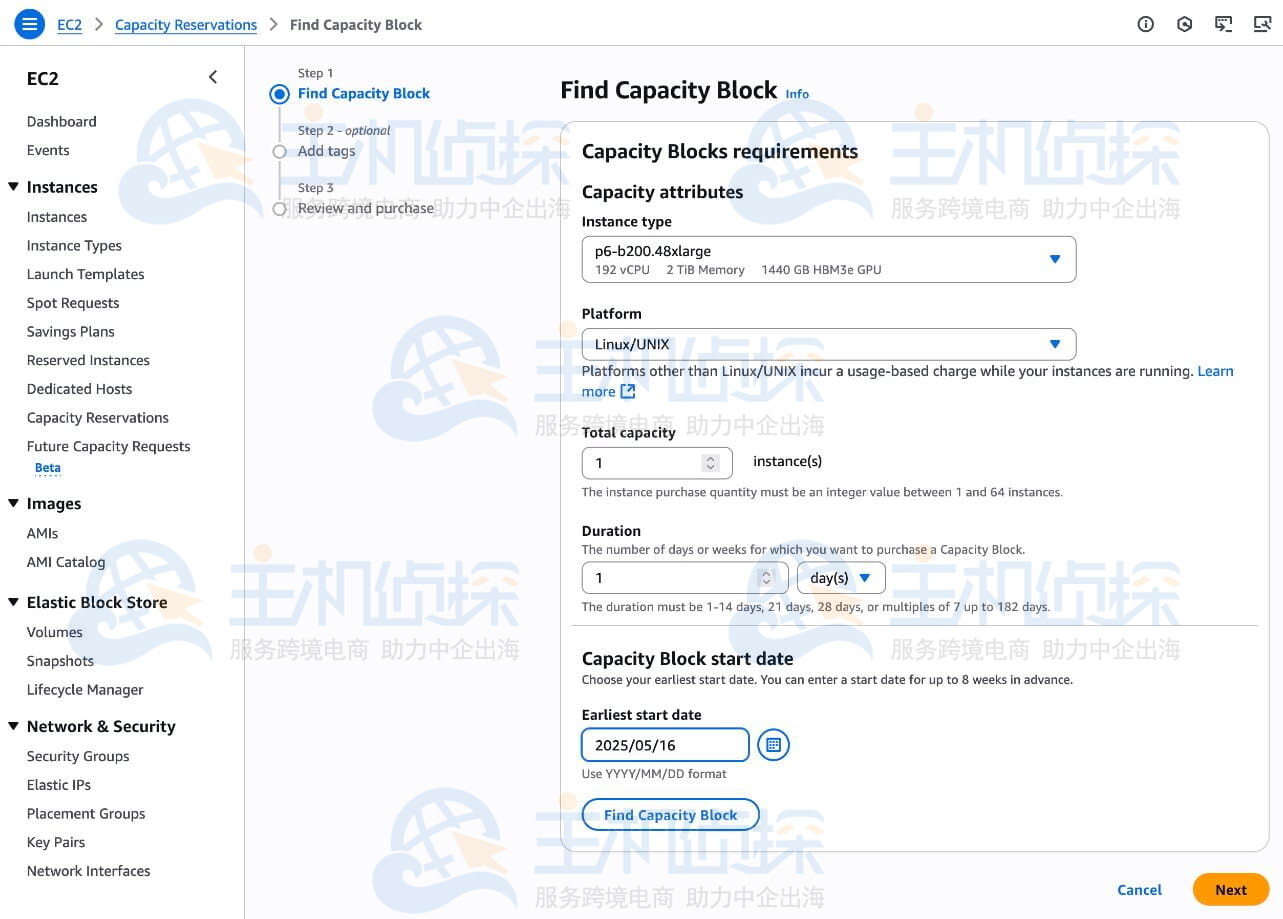

使用路径:

可以通过适用于ML的EC2容量块在美国西部(俄勒冈州)AWS区域使用P6-B200实例。要预留EC2容量块,请在Amazon EC2控制台上选择容量预留。

选择购买适用于ML的容量块,然后选择总容量并为p6-b200.48xlarge实例指定需要EC2容量块的时长。可以预留EC2容量块的总天数为1-14天、21天、28天或7到182天的倍数。最多可以提前8周选择最早的开始日期。

另外还可以使用AWS管理控制台、AWS命令行界面(AWS CLI)或AWS SDK运行实例。Amazon EC2 P6-B200实例还支持与各种AWS托管服务无缝集成,例如Amazon EKS、Amazon S3和适用于Lustre的Amazon FSx。对Amazon SageMaker HyperPod的支持也即将推出。

相关推荐:

《亚马逊免费云服务器Amazon EC2 T4g/x86领取及配置教程》

(本文由美国主机侦探原创,转载请注明出处“美国主机侦探”和原文地址!)

微信扫码加好友进群

主机优惠码及时掌握

QQ群号:164393063

主机优惠发布与交流