Database Mart美国主机商产品定位为不限流量的美国VPS、GPU服务器等网站解决方案,是外贸网站、AI推理、视频渲染等领域的明星主机商。Database Mart国外GPU服务器提供的显卡型号包括但不限于T1000、RTX3060 Ti、RTX4060、 A4090、RTX5060、V100等。其中NVIDIA RTX 4090是一款较受欢迎的存在,配备24GB GDDR6X显存,搭配先进的LLM运行平台Ollama。本文就深入分析Database Mart RTX 4090基准测试和Ollama基准测试,评估其在GPU服务器上托管和运行各种LLM的能力。

一、GPU服务器规格

Database Mart GPU服务器NVIDIA RTX 4090型号拥有82.6 TFLOPS的FP32性能、16384个CUDA核心和512个Tensor核心,在计算能力和性价比方面均超越了大多数消费级GPU。

1、服务器配置- 价格:409.00美元/月

- CPU:双18核E5-2697v4(36核72线程)

- 内存:256GB

- 存储:240GB SSD+2TB NVMe+8TB SATA

- 网络:100Mbps-1Gbps连接

- 操作系统:Windows 11专业版

- 软件:Ollama版本0.5.4

- GPU:Nvidia GeForce RTX 4090

- 计算能力:8.9

- 微架构:Ada Lovelace

- CUDA核心:16,384

- Tensor核心:512

- GPU显存:24GB GDDR6X

- FP32性能:82.6 TFLOPS

测试模型参数范围从80亿到400亿,涵盖轻量级到中型LLM,提供了多样化的测试范围。本次评估使用Ollama 0.5.4进行,评估的语言模型如下:

- LLaMA系列:LLaMA 2 (13B)、LLaMA 3.1 (8B)

- Qwen系列:Qwen (14B、32B)

- Phi系列:Phi4 (14B)

- Mistral模型:Mistral-small (22B)

- Falcon系列:Falcon (40B)

- Gemma和LLaVA:Gemma2 (27B)、LLaVA (34B)

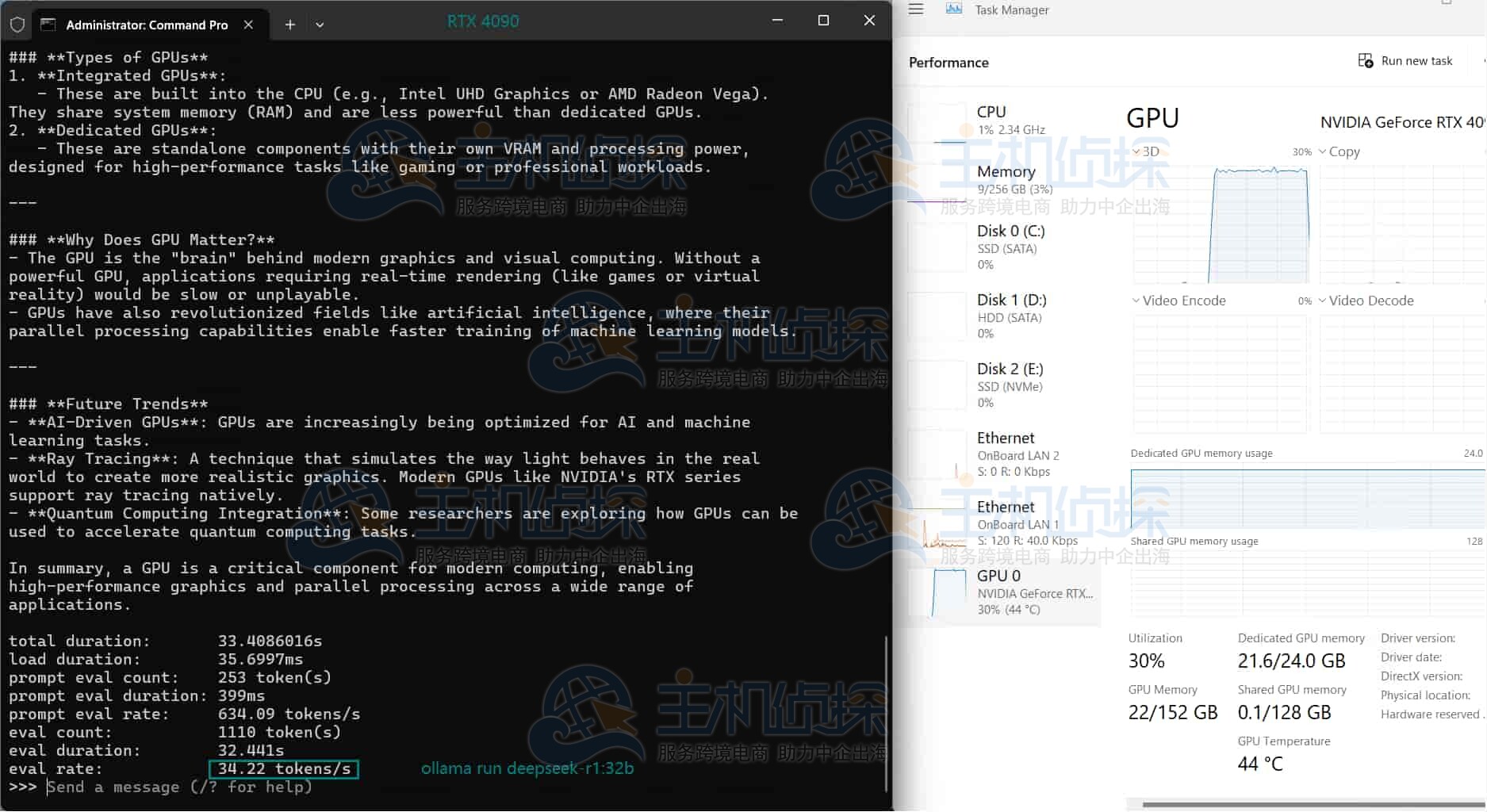

RTX 4090的性能表现非常出色,尤其是在处理中小型模型时。关键指标汇总如下:

| 模型 | deepseek-r1 | deepseek-r1 | llama2 | llama3.1 | qwen2.5 |

| 参数 | 14b | 32b | 13b | 8b | 14b |

| 尺寸 | 9 | 20 | 7.4 | 4.9 | 9 |

| 量化 | 4 | 4 | 4 | 4 | 4 |

| 运行于 | Ollama0.5.7 | Ollama0.5.7 | Ollama0.5.4 | Ollama0.5.4 | Ollama0.5.4 |

| 下载速度(mb/s) | 12 | 12 | 12 | 12 | 12 |

| CPU速率 | 2% | 3% | 1% | 2% | 3% |

| RAM速率 | 3% | 3% | 3% | 3% | 3% |

| GPU vRAM | 45% | 90% | 41% | 65% | 45% |

| GPU利用率 | 95% | 98% | 92% | 94% | 96% |

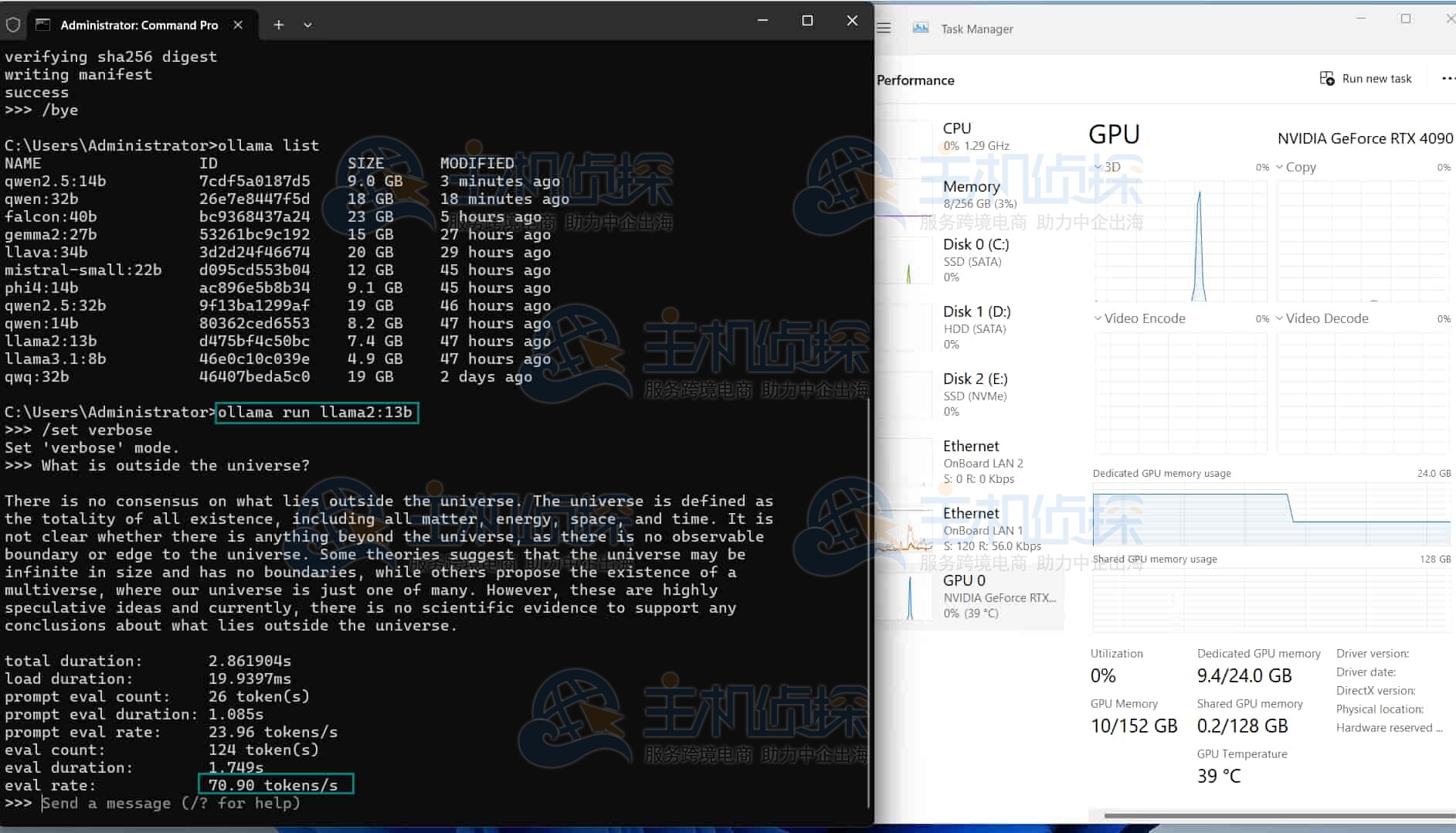

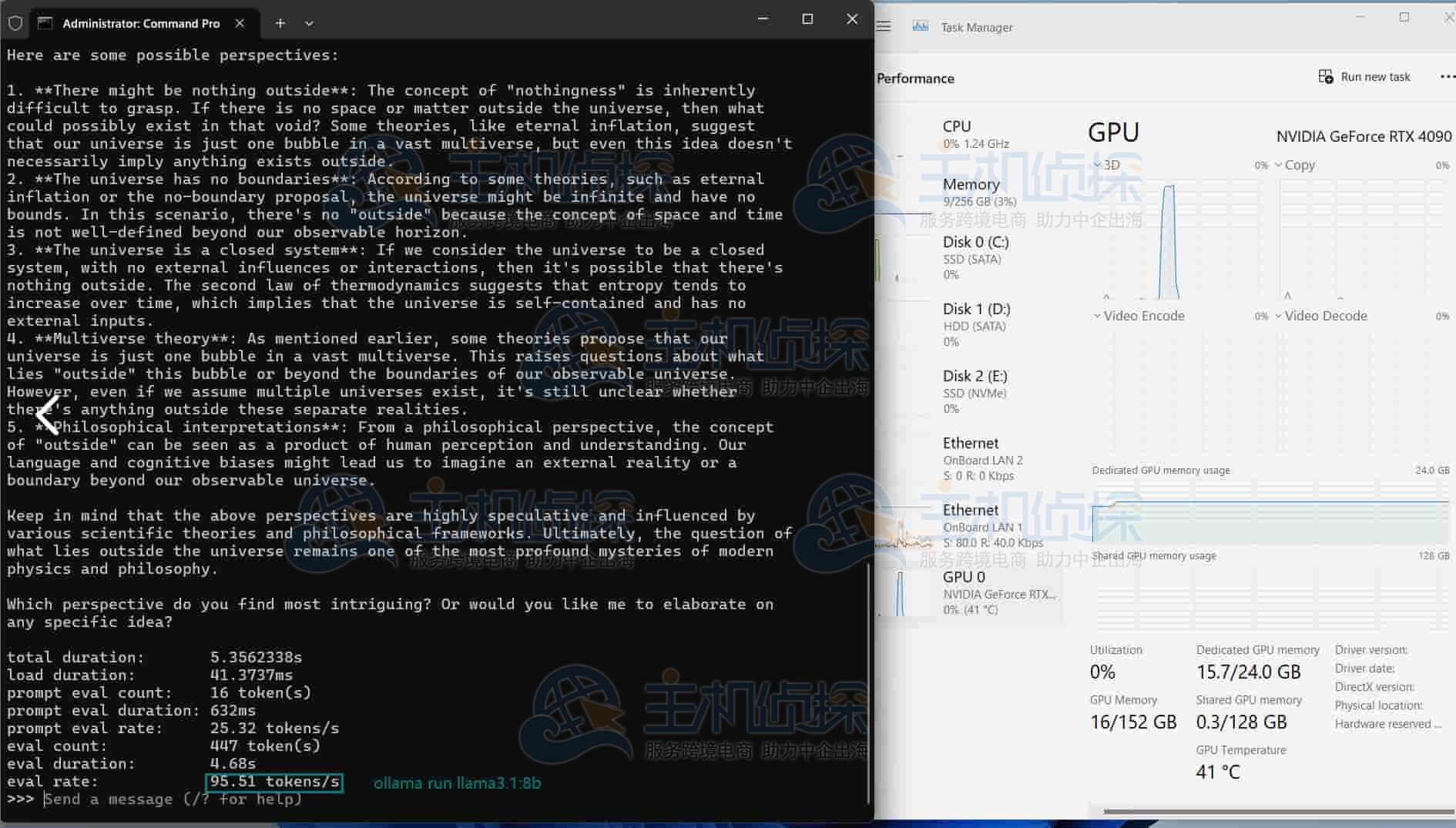

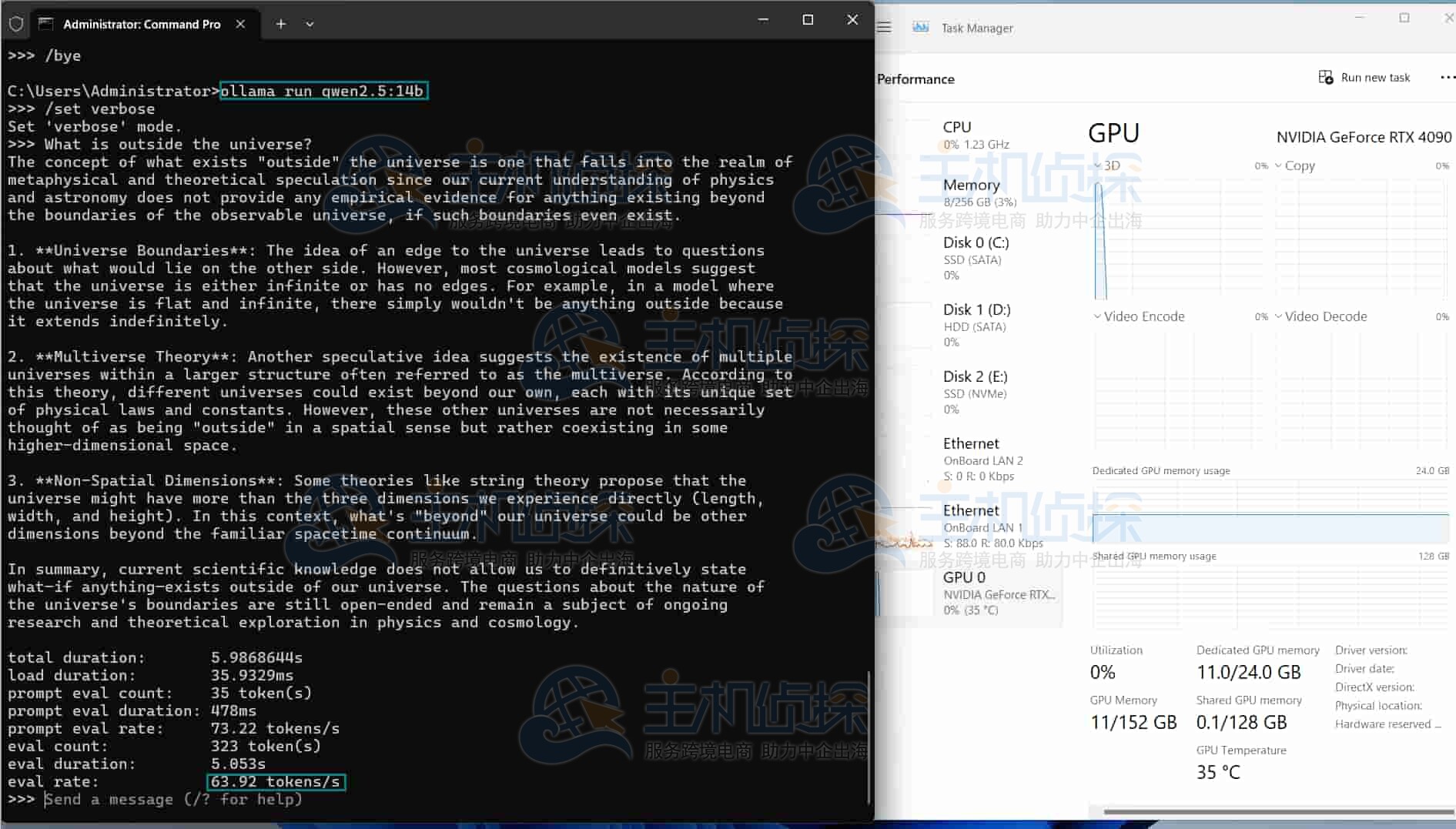

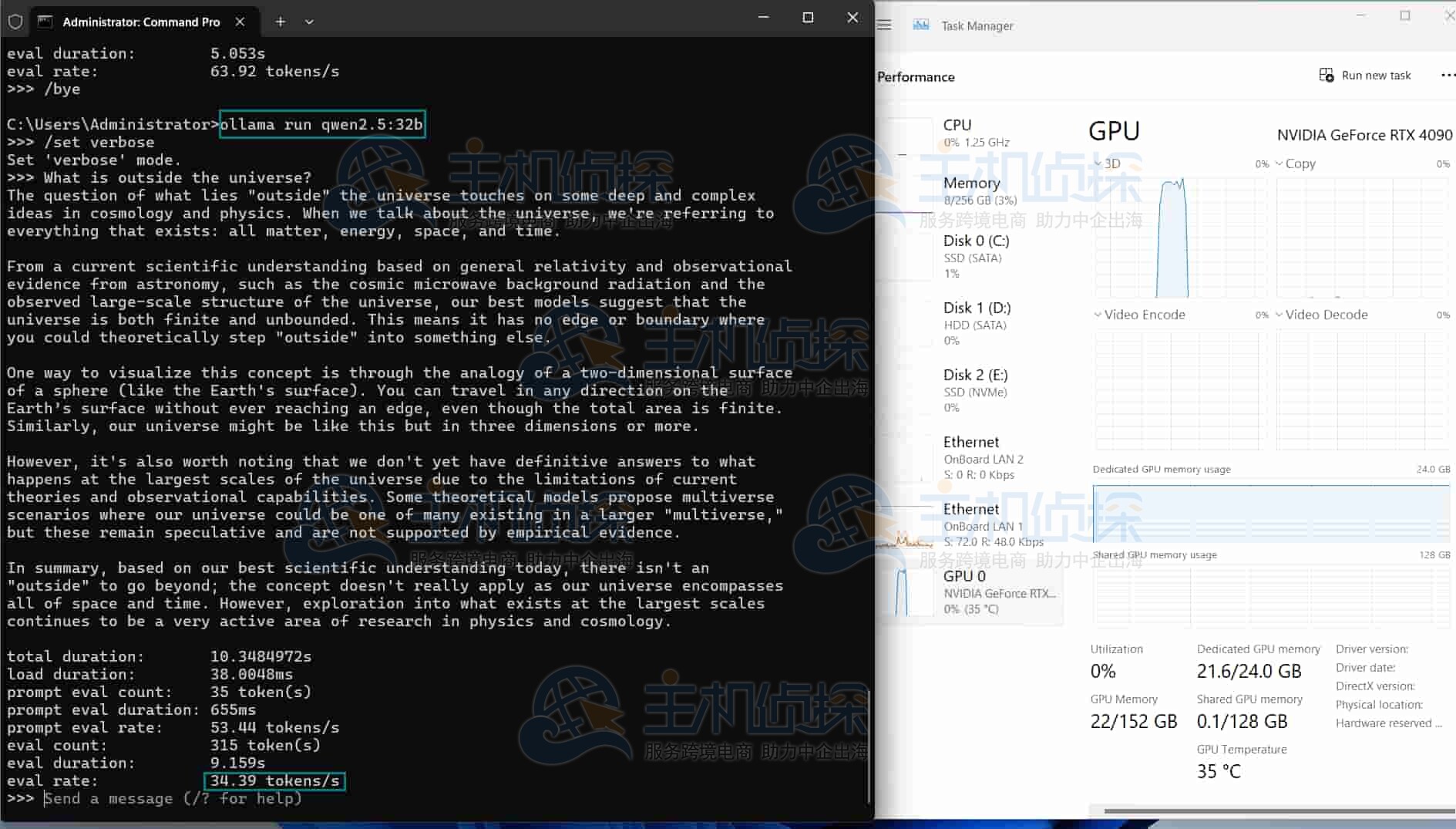

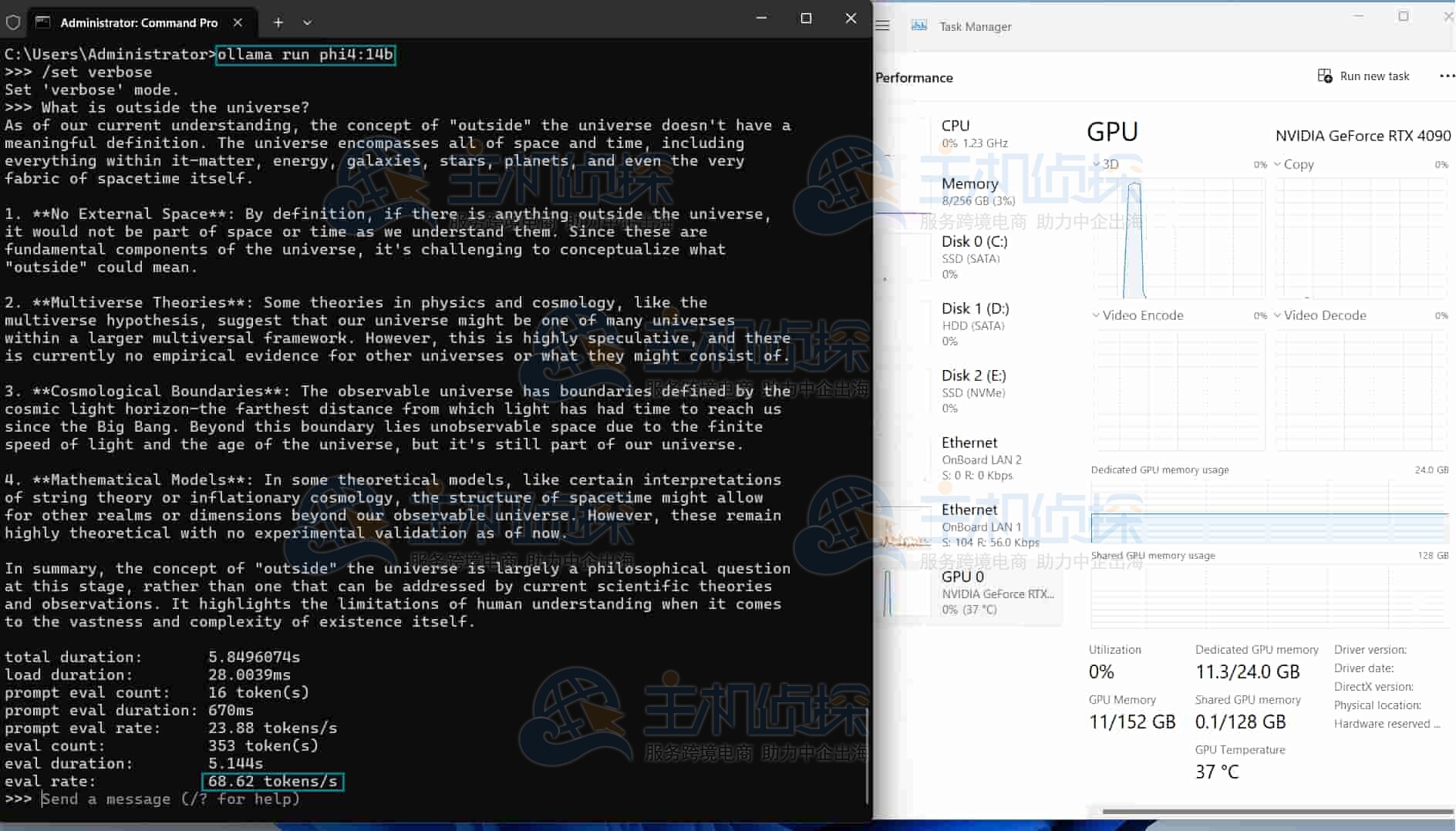

| 评估速率(tokens/秒) | 58.62 | 34.22 | 70.9 | 95.51 | 63.92 |

| 模型 | qwen2.5 | gemma2 | phi4 | qwq | llava |

| 参数 | 32b | 27b | 14b | 32b | 34b |

| 尺寸 | 20 | 16 | 9.1 | 20 | 19 |

| 量化 | 4 | 4 | 4 | 4 | 4 |

| 运行于 | Ollama0.5.4 | Ollama0.5.4 | Ollama0.5.4 | Ollama0.5.4 | Ollama0.5.4 |

| 下载速度(mb/s) | 12 | 12 | 12 | 12 | 12 |

| CPU速率 | 3% | 2% | 3% | 2% | 2% |

| RAM速率 | 3% | 3% | 3% | 3% | 3% |

| GPU vRAM | 90% | 78% | 47% | 90% | 92% |

| GPU利用率 | 97% | 96% | 97% | 99% | 97% |

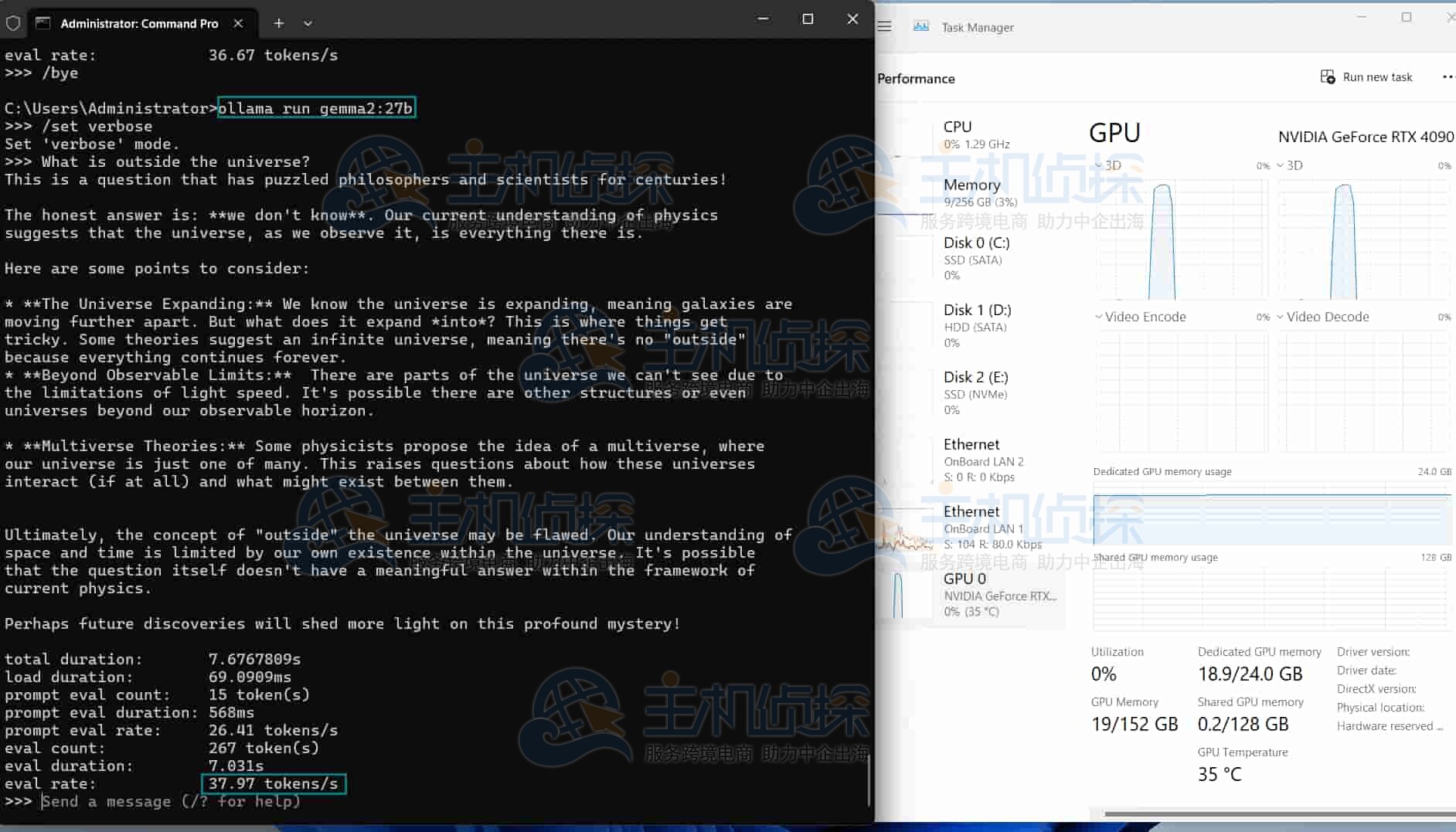

| 评估速率(tokens/秒) | 34.39 | 37.97 | 68.62 | 31.8 | 36.67 |

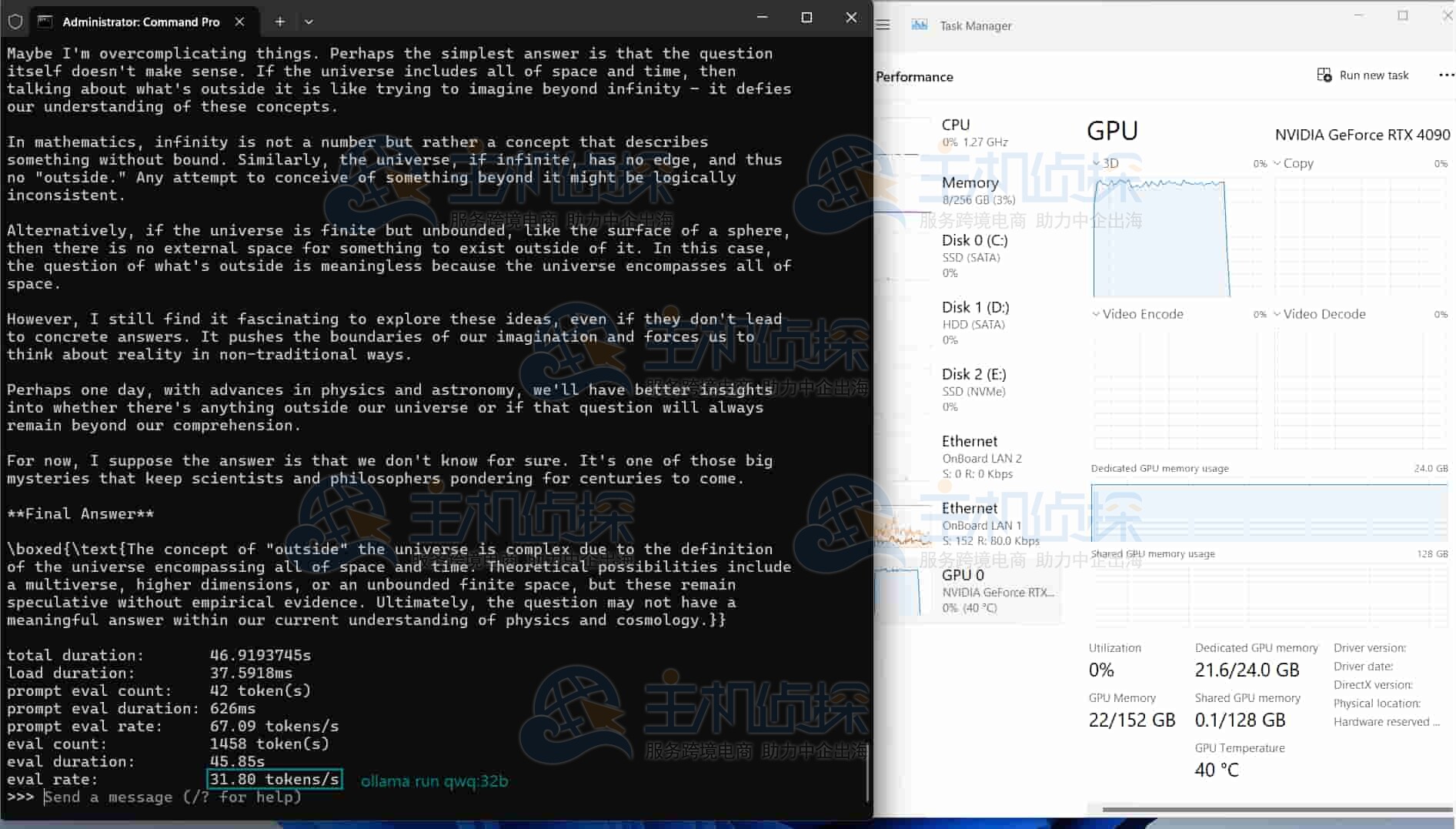

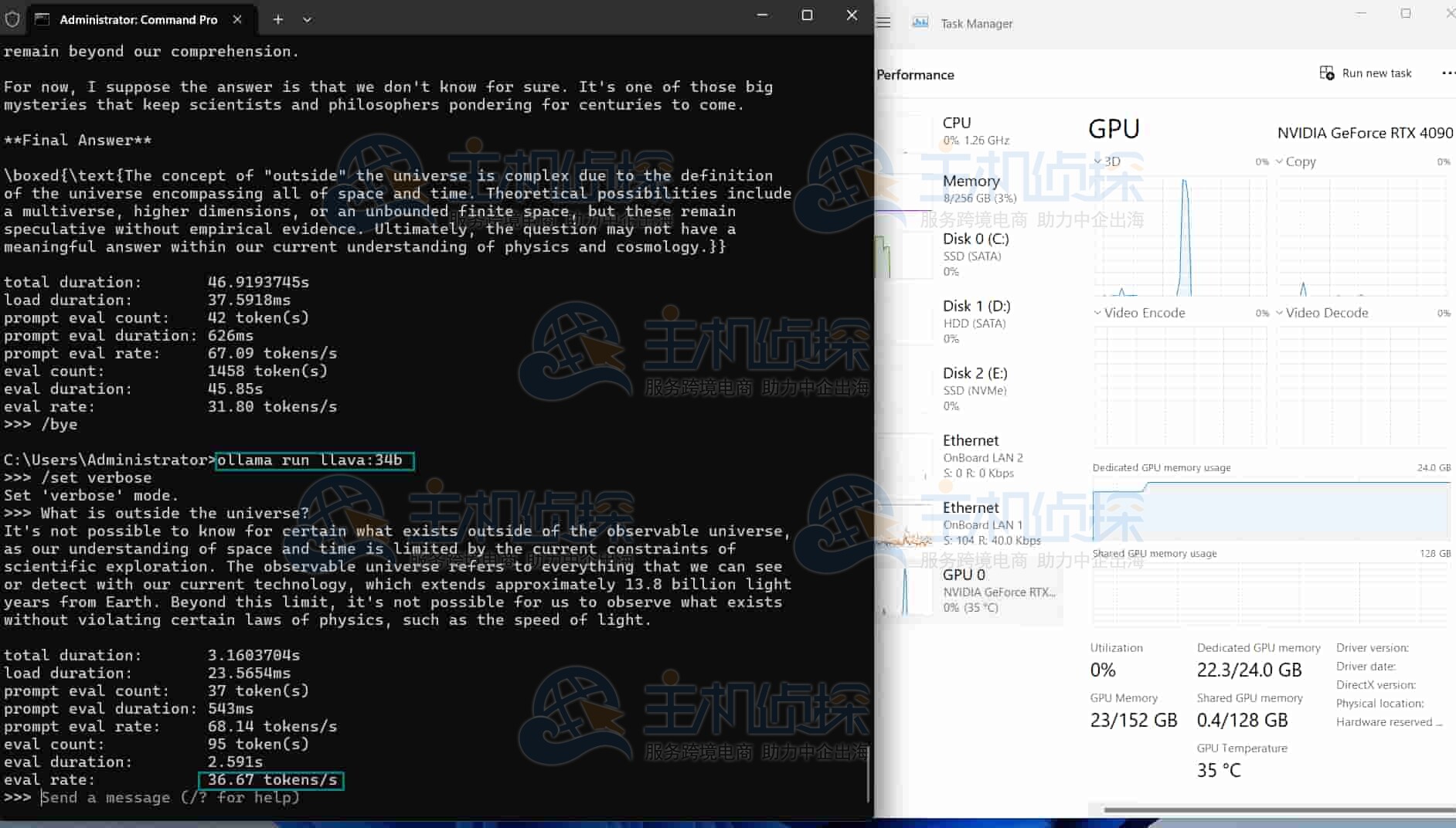

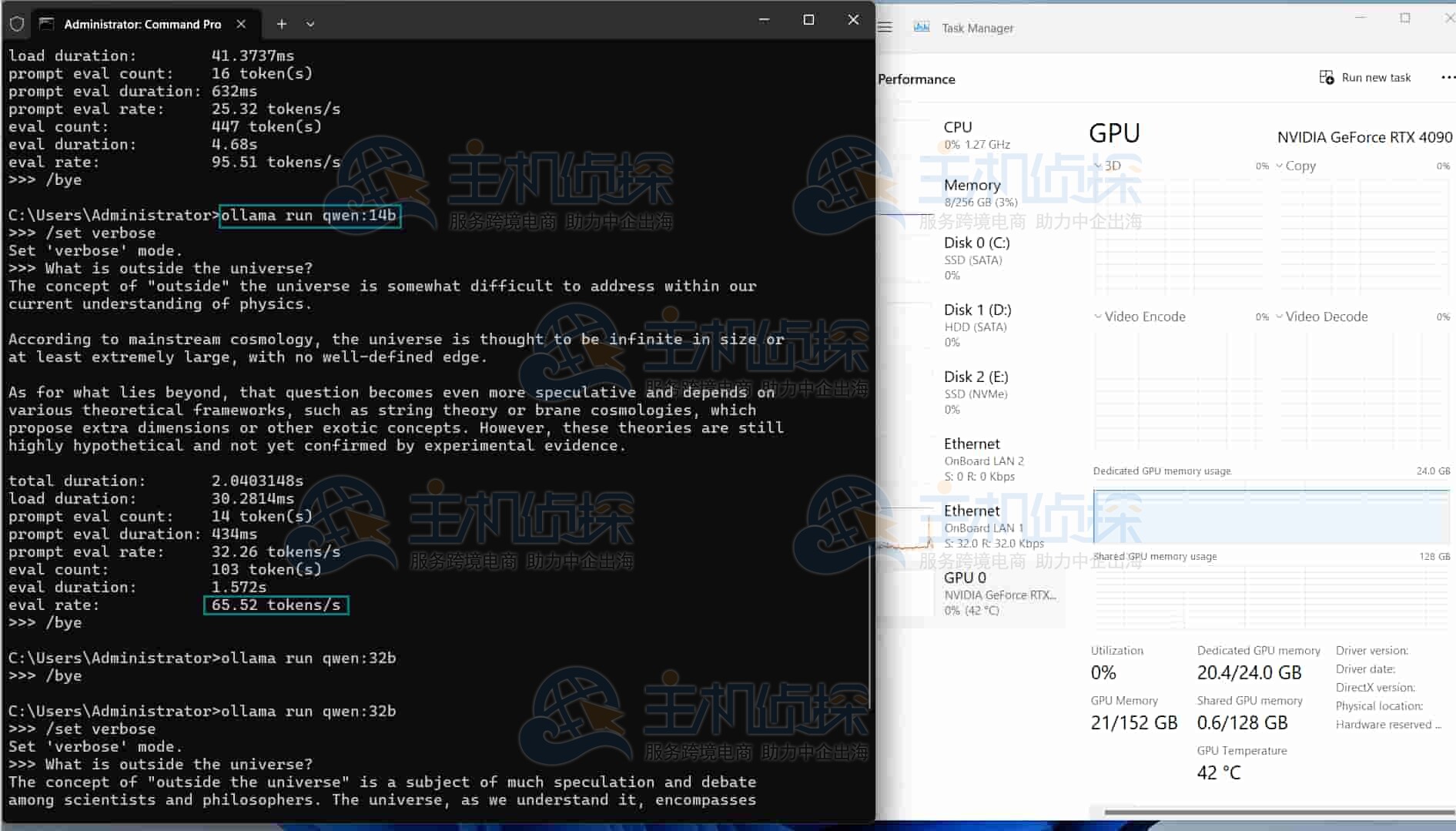

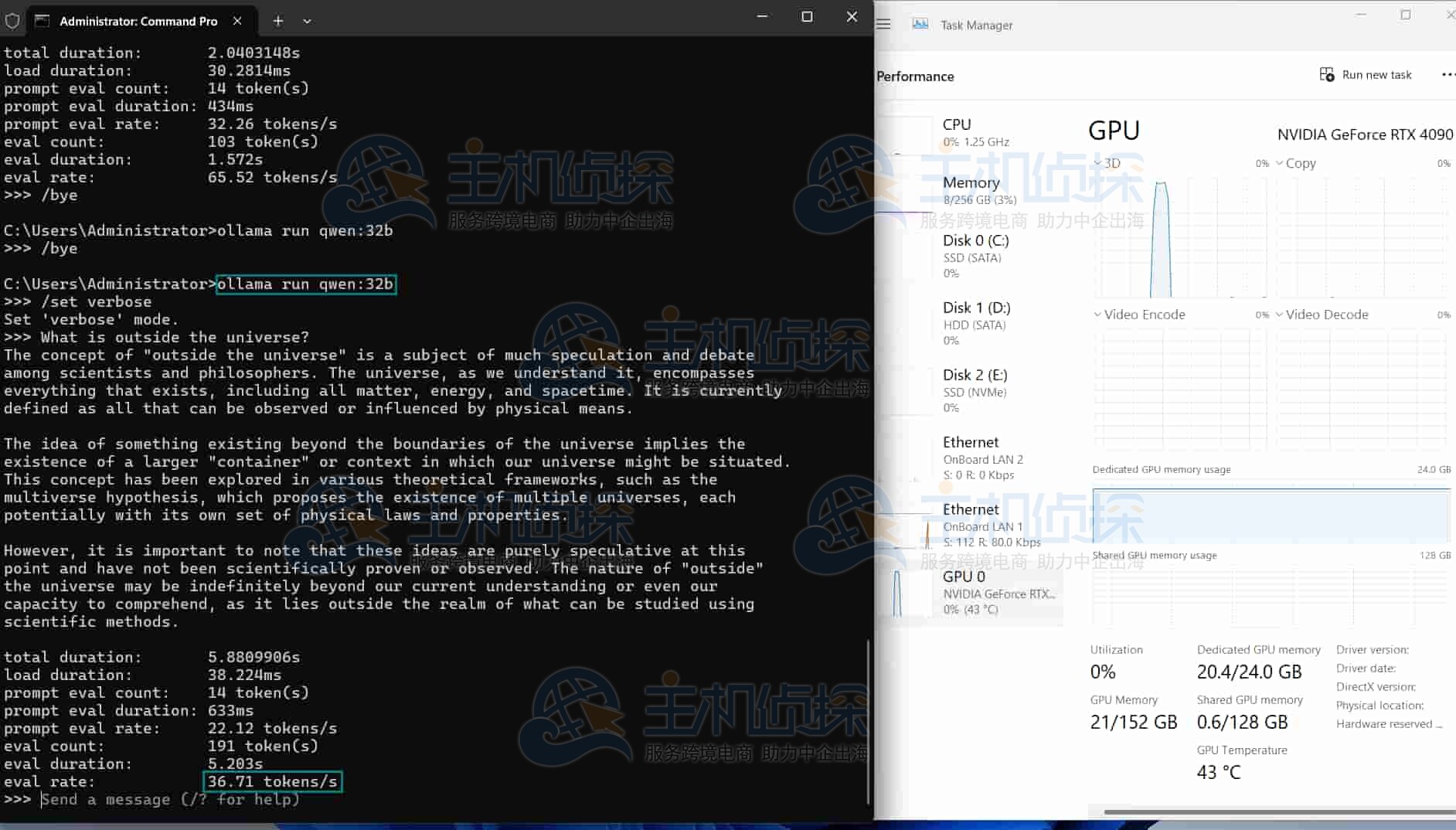

RTX4090 GPU服务器实时资源消耗数据的截图:

评测总结:

1、中小型模型 (8B-34B)

RTX 4090在运行轻量级和中型LLM方面表现出色,评估速度高达70个令牌/秒。对于LLaMA 2 (13B)和deepseek-r1 (34B)等模型,其GPU利用率始终保持在92%-96%,展现出极高的效率,同时CPU利用率仅为1%-3%。

2、无法处理40B模型

对于Falcon (40B) 等更大的模型,GPU出现了性能瓶颈,评估速度降至8.61 tokens/s。尽管Ollama采用了4位量化,但24GB显存限制使得RTX 4090难以以最佳速度处理这些工作负载。

3、性价比高

非常适合参数量高达36B的LLM基准测试。在中小规模推理任务中也能提供相当的性能。

4、不同模型的指标值:

下载速度:所有模型均为12 MB/s,订购1Gbps带宽扩展后可达118 MB/s;

- CPU利用率保持在1-3%

- 内存利用率保持在2-4%

- GPU显存利用率41-92%(模型越大,利用率越高)

- GPU利用率92%以上

- 评估速度30+个token/s(建议使用36亿以下的模型)

在Database Mart 24GB显存的GPU中,RTX 4090在FP32性能和CUDA核心数量方面遥遥领先,使其成为推理任务最具性价比的选择。

虽然Database Mart A6000可以处理36-70亿的模型,但在处理8-36亿模型时,其计算吞吐量远低于4090。尽管RTX 4090拥有诸多优势,但它无法高效处理参数超过400亿的模型。此类型号通常需要48GB或更多显存(例如NVIDIA A6000、H100或A100),凸显了超大型LLM的硬件限制。

Database Mart国外GPU服务器推荐方案及配置:

| GPU型号 | 价格/月 | 内存 | CPU配置 | 存储配置 | 网络带宽 | 操作系统 | GPU核心参数 |

| RTX 4090 | 409 | 256GB | 双18核E5-2697v4 | 240GB SSD+2TB NVMe+8TB SATA | 100Mbps-1Gbps | Windows/Linux | 微架构:Ada Lovelace CUDA 核心:16,384 Tensor 核心:512 显存:24GB GDDR6X FP32 性能:82.6 TFLOPS |

| RTX A6000 | 356 | 256GB | 双18核E5-2697v4 | 240GB SSD+2TB NVMe+8TB SATA | 100Mbps-1Gbps | Windows/Linux | 微架构:Ampere CUDA 核心:10,752 Tensor 核心:336 显存:48GB GDDR6 FP32 性能:38.71 TFLOPS |

| A100 | 399.5 | 256GB | 双18核E5-2697v4 | 240GB SSD+2TB NVMe+8TB SATA | 100Mbps-1Gbps | Windows/Linux | 微架构:Ampere CUDA 核心:6912 Tensor 核心:432 显存:40GB HBM2 FP32 性能:19.5 TFLOPS |

| 2×RTX4090 | 729 | 256GB | 双18核E5-2697v4 | 240GB SSD+2TB NVMe+8TB SATA | 1Gbps | Windows/Linux | 微架构:Ada Lovelace CUDA 核心:16,384 / 单卡 Tensor 核心:512 / 单卡 显存:24GB GDDR6X / 单卡 FP32 性能:82.6 TFLOPS / 单卡 |

相关推荐:

《Database Mart美国Windows VPS运行ERPNext真实评测》

《6个适用于AI和深度学习的热门GPU型号(附服务器推荐)》

(本文由美国主机侦探原创,转载请注明出处“美国主机侦探”和原文地址!)

微信扫码加好友进群

主机优惠码及时掌握

QQ群号:164393063

主机优惠发布与交流