本文主要分享Ubuntu 22.04 GPU服务器一键部署Ollama+Open WebUI完整教程。借助NVIDIA显卡硬件加速,大幅提升AI推理速度,搭配网页交互界面,不用复杂配置也可拥有专属私人AI对话服务。

一、环境前置要求

1、操作系统:Ubuntu 22.04 服务器

2、显卡配置:NVIDIA独立GPU,显存不低于16GB

选购参考:《6个适用于AI和深度学习的热门GPU型号(附服务器推荐)》

3、权限要求:拥有root权限或sudo管理员权限

4、网络环境:网络稳定通畅

二、安装NVIDIA显卡驱动首先完成显卡驱动部署,确保GPU可以正常调用。

sudo apt update

sudo apt install -y ubuntu-drivers-common

ubuntu-drivers devices # 查看系统推荐适配驱动

sudo ubuntu-drivers autoinstall

执行完成后重启服务器:

sudo reboot

重启后验证显卡是否识别成功:

nvidia-smi

终端正常输出显卡型号、显存、占用信息,即代表驱动安装正常。

三、安装CUDA运算工具包Ollama依靠CUDA实现GPU算力加速,推荐安装CUDA 12.x版本。

https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/x86_64/cuda-ubuntu2204.pin

sudo mv cuda-ubuntu2204.pin /etc/apt/preferences.d/cuda-repository-pin-600wget https://developer.download.nvidia.com/compute/cuda/12.2.2/local_installers/cuda-repo-ubuntu2204-12-2-local_12.2.2-1_amd64.deb

sudo dpkg -i cuda-repo-ubuntu2204-12-2-local_12.2.2-1_amd64.deb

sudo cp /var/cuda-repo-ubuntu2204-12-2-local/cuda-*-keyring.gpg /usr/share/keyrings/

sudo apt update

sudo apt install -y cuda

校验CUDA是否安装完成:

四、一键安装Ollama大模型运行引擎nvcc –version

直接执行官方一键脚本,快速部署Ollama运行环境:

curl -fsSL https://ollama.com/install.sh | sh

查看Ollama服务运行状态:

systemctl status ollama

快速测试模型是否可用:

ollama run tinyllama

拉取其他常用大模型命令:

五、安装Docker容器环境ollama pull gpt-oss:20b

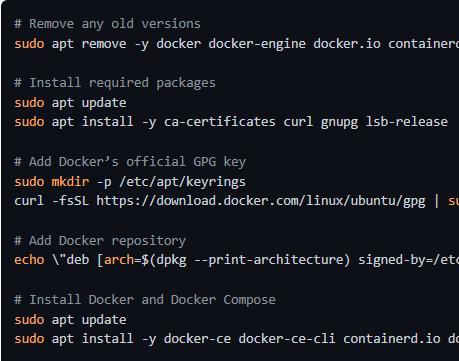

Open WebUI需要依托Docker容器运行,依次执行以下命令安装Docker与Docker Compose:

# 清理旧版本残留Docker组件

sudo apt remove -y docker docker-engine docker.io containerd runcsudo apt update

sudo apt install -y ca-certificates curl gnupg lsb-release# 添加Docker官方密钥

sudo mkdir -p /etc/apt/keyrings

curl -fsSL https://download.docker.com/linux/ubuntu/gpg | sudo gpg –dearmor -o /etc/apt/keyrings/docker.gpg# 配置Docker软件源

echo “deb [arch=$(dpkg –print-architecture) signed-by=/etc/apt/keyrings/docker.gpg] https://download.docker.com/linux/ubuntu $(lsb_release -cs) stable” | sudo tee /etc/apt/sources.list.d/docker.list > /dev/null# 安装Docker全套组件

sudo apt update

sudo apt install -y docker-ce docker-ce-cli containerd.io docker-buildx-plugin docker-compose-plugin

开机自启Docker并测试运行:

sudo systemctl enable –now docker

sudo docker run hello-world

配置普通用户免sudo执行Docker命令:

sudo usermod -aG docker $USER

newgrp docker

查看Docker Compose版本:

六、部署Open WebUI可视化网页面板docker compose version

克隆项目源码并后台启动容器服务:

git clone https://github.com/open-webui/open-webui.git

cd open-webui

docker compose up -d

浏览器访问地址:http://服务器IP:3000

七、WebUI关联对接本地Ollama服务进入网页后台操作:

设置>后端接口>选择Ollama,填写接口地址:

- 本地容器互通:http://host.docker.internal:11434

- 远程外网访问:http://服务器IP:11434

让Docker容器直接调用服务器GPU,大幅提升大模型推理速度。

# 安装NVIDIA容器运行工具

distribution=$(. /etc/os-release;echo $ID$VERSION_ID)

curl -s -L https://nvidia.github.io/nvidia-docker/gpgkey | sudo apt-key add –

curl -s -L https://nvidia.github.io/nvidia-docker/$distribution/nvidia-docker.list | sudo tee /etc/apt/sources.list.d/nvidia-docker.listsudo apt update

sudo apt install -y nvidia-container-toolkit

sudo systemctl restart docker

修改Open WebUI目录下`docker-compose.yml`配置文件,添加GPU资源分配:

yaml

services:

open-webui:

deploy:

resources:

reservations:

devices:

– driver: nvidia

count: all

capabilities: [gpu]

重启容器生效配置:

九、验证GPU是否正常负载运行docker compose down

docker compose up -d

运行一款大模型:

ollama run gpt-oss:20b

新开终端查看显卡占用:

nvidia-smi

页面显示Ollama占用显卡显存,即GPU加速部署成功。

十、自由下载模型在线对话使用通过Ollama一键拉取各类开源大模型:

ollama pull gpt-oss

ollama pull deepseek-r1

ollama pull llama3

ollama pull llama4

ollama pull gemma3

ollama pull phi4

ollama pull codellama

在Open WebUI面板切换对应模型,即可浏览器网页端流畅对话。

相关推荐:

《Database Mart GPU服务器 RTX 4090+Ollama运行LLM基准测试》

《n8n+Ollama+DeepSeek创建个人AI智能体教程》

《Database Mart美国GPU VPS搭建本地大语言模型环境真实评测》

(本文由美国主机侦探原创,转载请注明出处“美国主机侦探”和原文地址!)

微信扫码加好友进群

主机优惠码及时掌握

QQ群号:164393063

主机优惠发布与交流