相比云服务部署,本地Ubuntu部署OpenClaw更适合只想本地用AI自动化、测试、学习、调试等用途,仅需支付API的成本。如阿里云百炼平台针对新用户推出了首月7.9元的Coding Plan编程套餐,单次订阅可用8款模型(Qwen3.5、GLM-5、MiniMax M2.5、Kimi K2.5等)。下文详细分享Linux Ubuntu系统本地部署OpenClaw的详细教程。

一、前提条件

1、一个Linux Ubuntu环境

2、安装Node.js 22以上版本(下文详解)

3、一个有效的API KEY(下文详解)

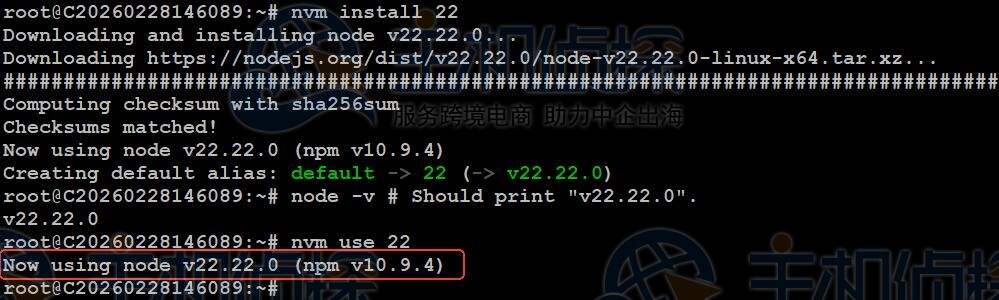

二、Node.js安装及版本检查1、安装nvm工具

curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.39.0/install.sh | bash

2、启动nvm

source ~/.bashrc

3、通过nvm安装Node.js 22.x最新版本

nvm install 22

4、将当前终端会话的Node.js版本切换到22.x

nvm use 22

1、全局安装OpenClaw

确认Node.js >= v22后,请执行以下安装命令:

npm install -g openclaw@latest

2、验证安装(查看OpenClaw版本)

openclaw –version

类似输出:

![]()

若提示”command not found”,可能是npm全局路径未加入系统PATH,重启终端即可解决;若还是无法解决,检查npm全局路径:npm prefix -g,然后把返回的路径加入PATH环境变量即可。

3、启用OpenClaw配置向导

使用以下命令完成初始化配置:

openclaw onboard –install-daemon

OpenClaw配置向导流程:

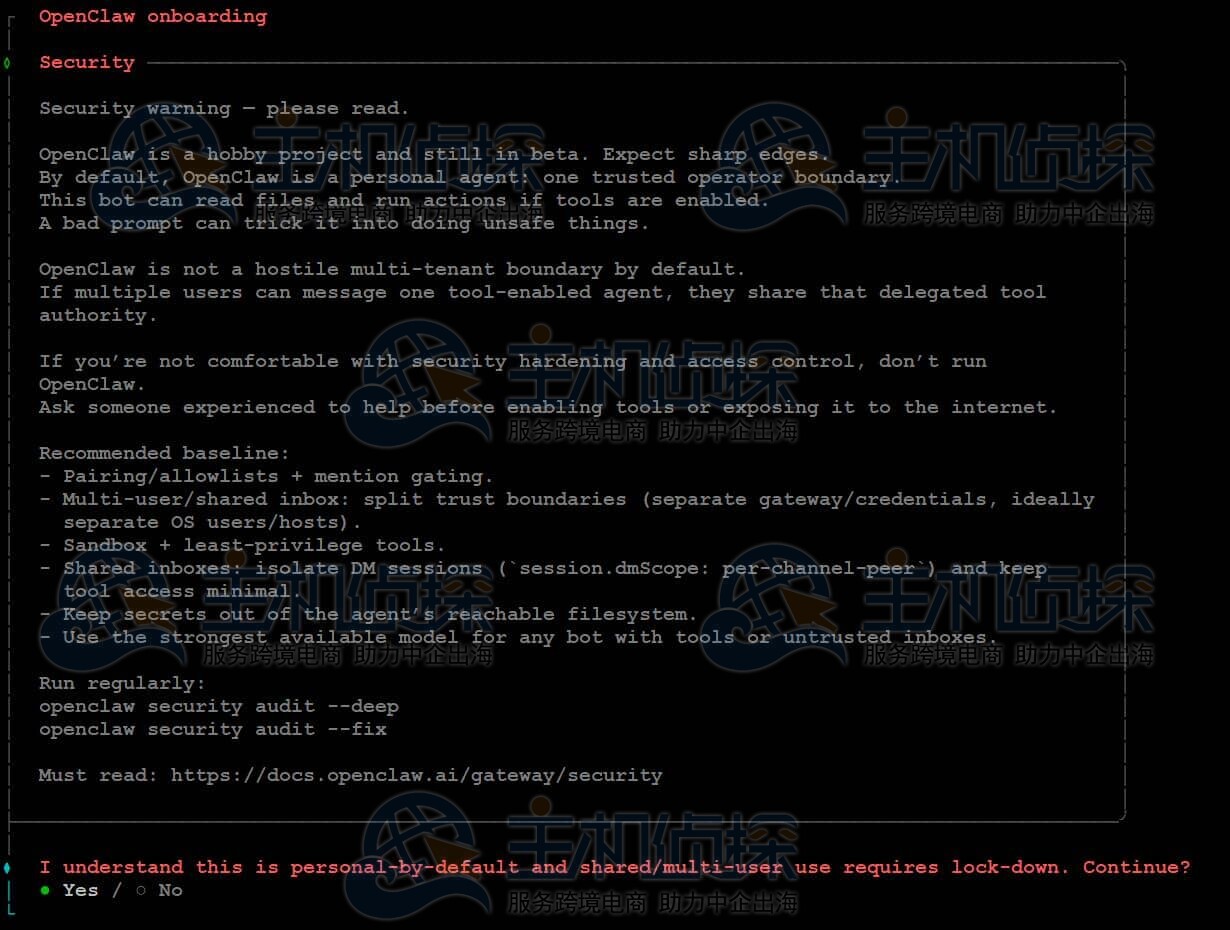

(1)风险确认

启动向导后,首先会看到如下提示:

此处选择Yes继续即可。

若你此前安装过OpenClaw,还会出现以下提示:

Existing config detected

…

? Config handling

❯ Use existing values

Update values

Reset

配置处理选项选择建议:

- 首次安装:通常不会出现该提示,直接进入下一步;

- 重装/更换模型:推荐选Update values(保留其他稳定配置,仅更新需要调整的项);

- 完全重置配置:选Reset(谨慎操作,会清空所有原有配置)。

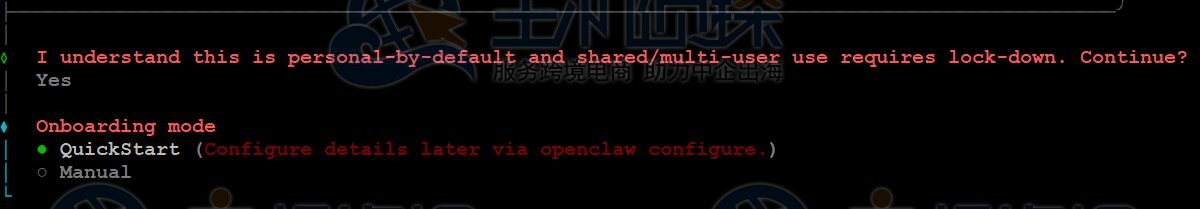

(2)选择部署模式(Onboarding mode)

向导会弹出模式选择提示:

模式选择对照:

- QuickStart:新手、想快速启动使用,自动配置官方推荐的基础设置;

- Manual:需完全掌控所有配置项,需逐个手动配置每一项参数。

建议首次部署优先选QuickStart,后续可随时在配置中修改参数。

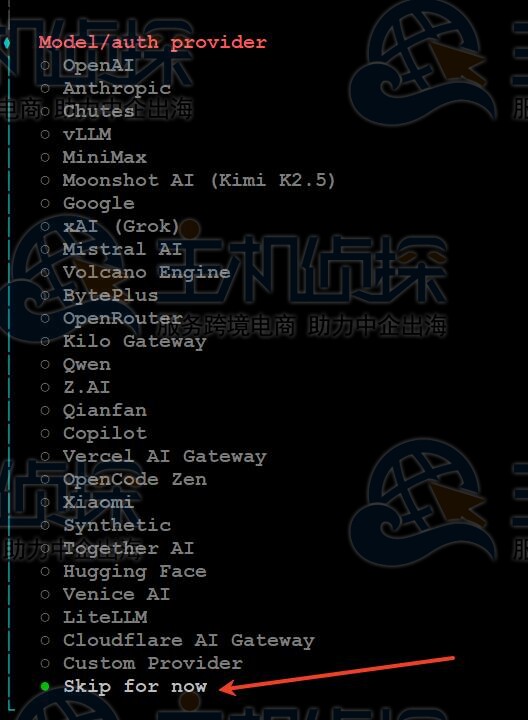

(3)选择模型厂商(Provider)

向导会提示选择模型服务商:

这里先选择“Skip for now”跳过,我们后面会配置。

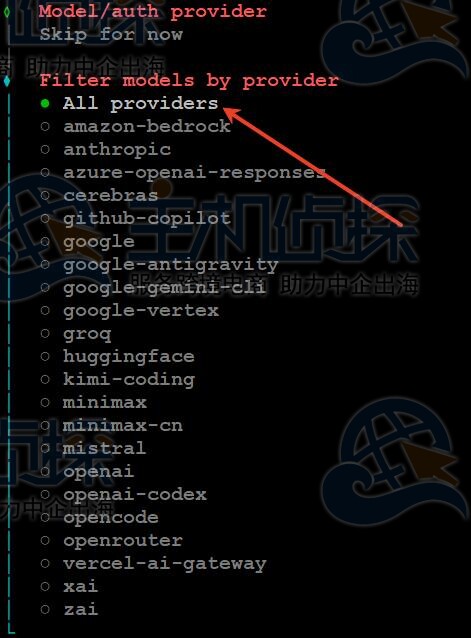

(4)按提供商筛选模型

选择“All providers”。

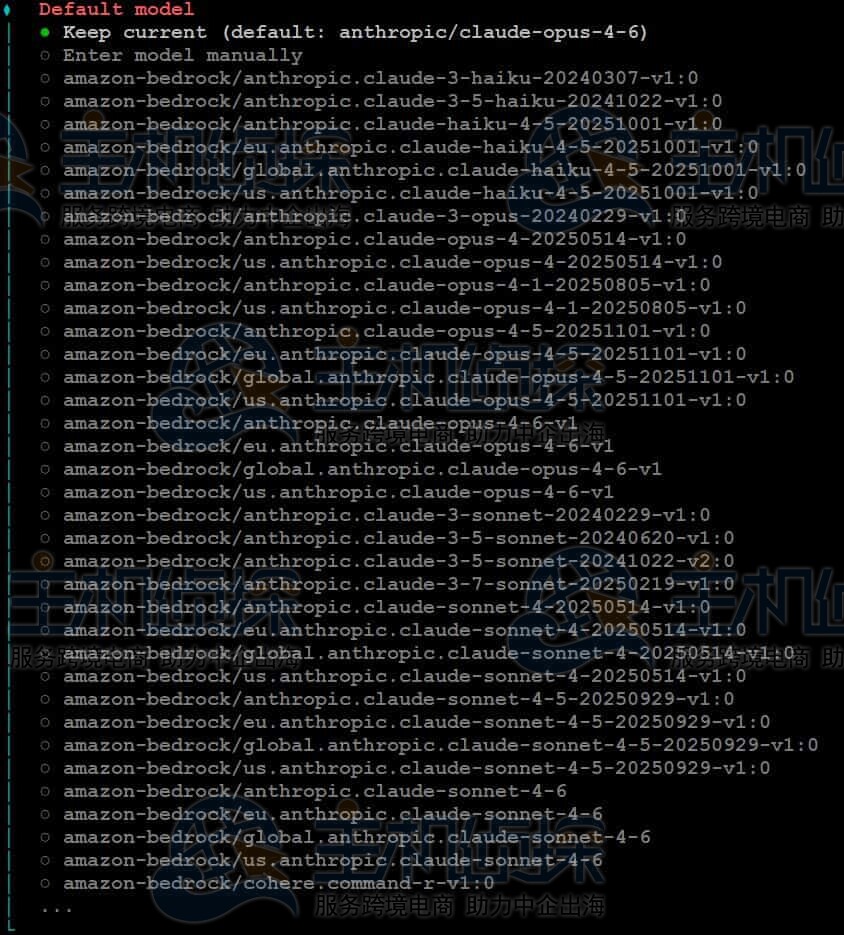

(5)默认模型

选择第一个保持当前。

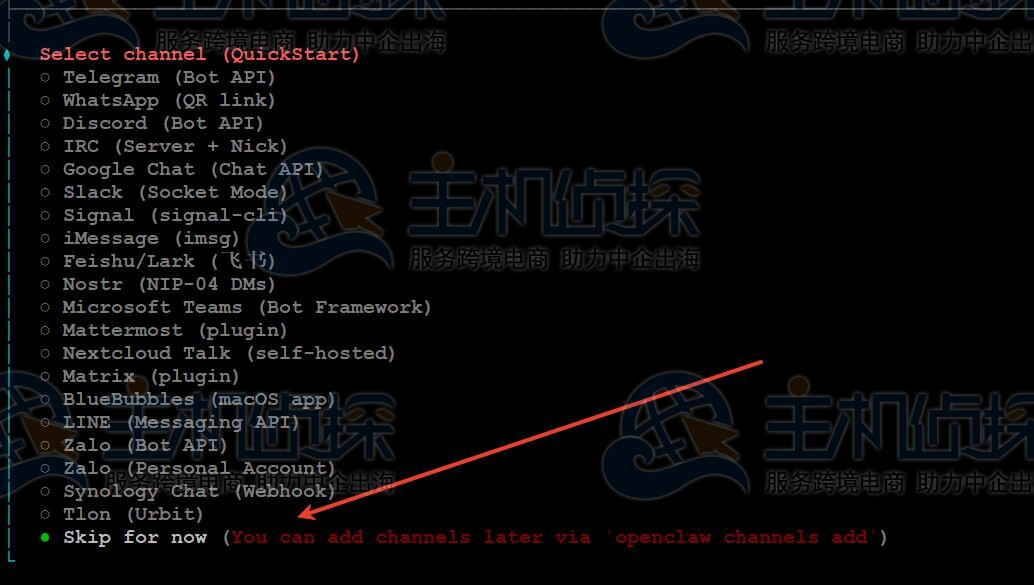

(6)配置Channel(建议先跳过)

在QuickStart模式下,完成上述步骤后会进入渠道选择列表:

首次部署建议直接选“Skip for now”(后续接入社交平台可更新配置)。

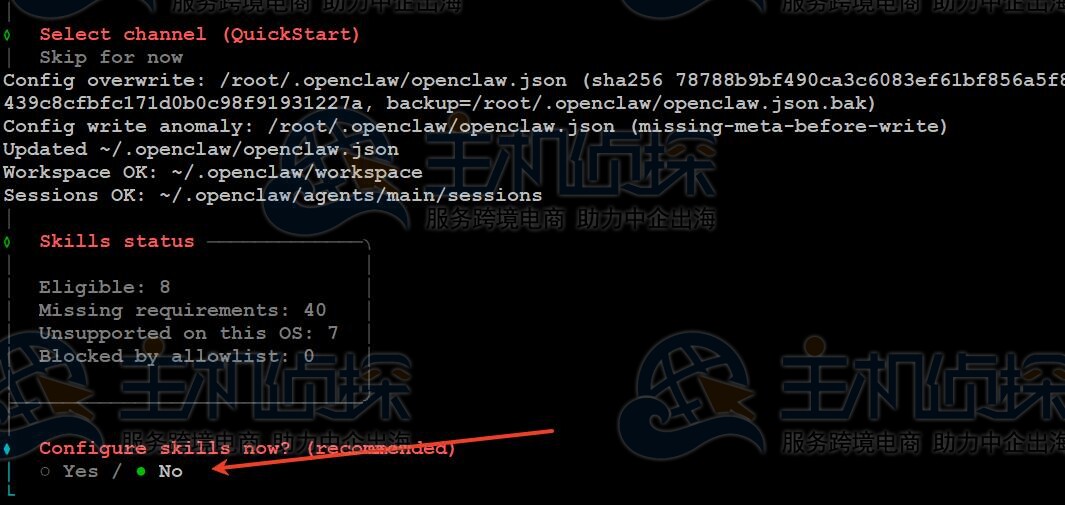

(7)配置Skills

完成Channel配置后,向导会进入Skills检查与可选安装环节:

这里先选择“No”。

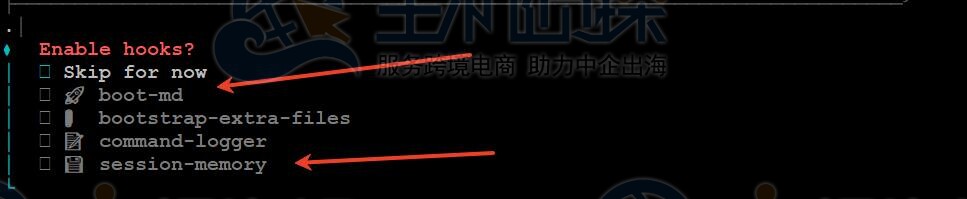

(8)在特定命令触发时自动执行预设动作(建议最小化开启)

选择boot-md和session-memory(按空格键选中)。

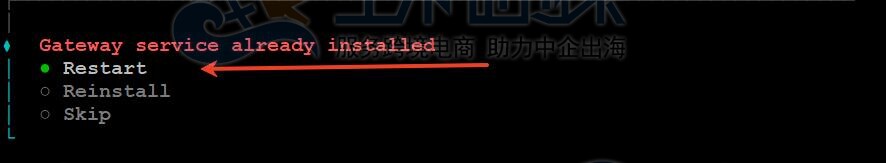

(9)重启网关

选择第一个。

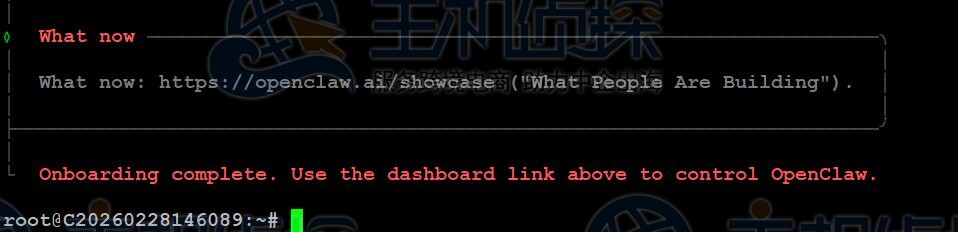

到目前为止已完成OpenClaw配置向导。

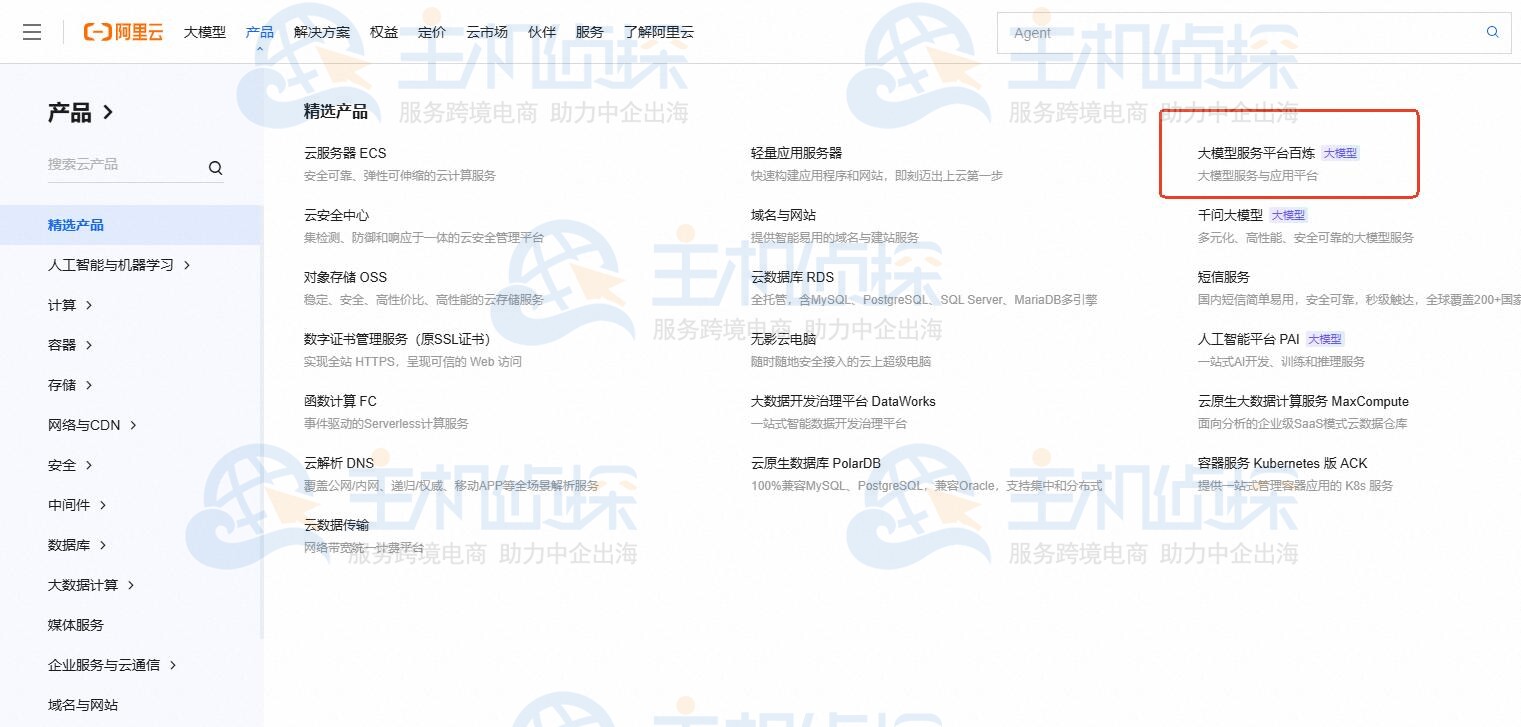

1、阿里百炼Coding Plan并获取API Key

访问阿里云官网,顶部导航栏产品部分找到“大模型服务器平台百炼”。

进入阿里云百炼平台点击顶部“Coding Plan”即可购买。

Coding Plan套餐版本如下:

- Lite基础版:40/月,首月7.9,每月18000次请求

- Pro高级版:200/月,首月39.9,每月90000次请求

支付完成后在Coding Plan页面找到API Key(一般格式为sk-sp-xxxxx,和百炼通用的sk-xxxxx略有区别)

2、接入阿里百炼Coding Plan

(1)在终端执行以下命令打开Web UI。

openclaw dashboard

(2)在Web UI的左侧菜单栏中选择配置>All Settings>RAW。

复制以下内容到Raw JSONS输入框,替换已有内容。

将YOUR_API_KEY替换为Coding Plan专属API Key。

{

"models": {

"mode": "merge",

"providers": {

"bailian": {

"baseUrl": "https://coding.dashscope.aliyuncs.com/v1",

"apiKey": "YOUR_API_KEY",

"api": "openai-completions",

"models": [

{

"id": "qwen3.5-plus",

"name": "qwen3.5-plus",

"reasoning": false,

"input": ["text", "image"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 1000000,

"maxTokens": 65536

},

{

"id": "qwen3-max-2026-01-23",

"name": "qwen3-max-2026-01-23",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 262144,

"maxTokens": 65536

},

{

"id": "qwen3-coder-next",

"name": "qwen3-coder-next",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 262144,

"maxTokens": 65536

},

{

"id": "qwen3-coder-plus",

"name": "qwen3-coder-plus",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 1000000,

"maxTokens": 65536

},

{

"id": "MiniMax-M2.5",

"name": "MiniMax-M2.5",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 204800,

"maxTokens": 131072

},

{

"id": "glm-5",

"name": "glm-5",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 202752,

"maxTokens": 16384

},

{

"id": "glm-4.7",

"name": "glm-4.7",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 202752,

"maxTokens": 16384

},

{

"id": "kimi-k2.5",

"name": "kimi-k2.5",

"reasoning": false,

"input": ["text", "image"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 262144,

"maxTokens": 32768

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "bailian/qwen3.5-plus"

},

"models": {

"bailian/qwen3.5-plus": {},

"bailian/qwen3-max-2026-01-23": {},

"bailian/qwen3-coder-next": {},

"bailian/qwen3-coder-plus": {},

"bailian/MiniMax-M2.5": {},

"bailian/glm-5": {},

"bailian/glm-4.7": {},

"bailian/kimi-k2.5": {}

}

}

},

"gateway": {

"mode": "local"

}

}

单击右上角Save保存,然后单击Update使配置生效。

保存成功后,apiKey将显示为“__OPENCLAW_REDACTED__”。脱敏保护,仅用于前端界面隐藏,不影响实际调用。

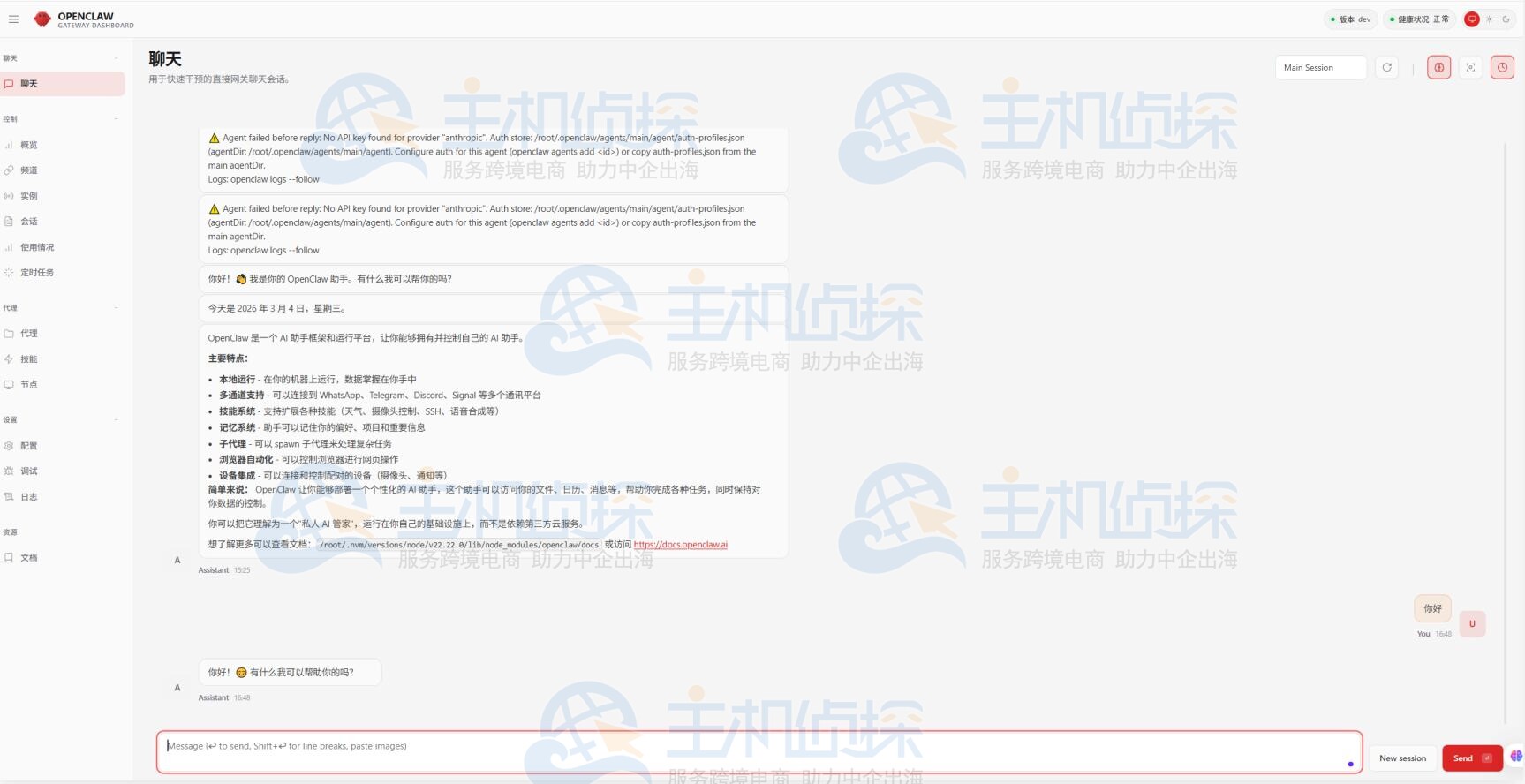

五、本地使用OpenClaw现在可在Web UI中进行对话。

输入WebUI地址后页面提示类似「未授权」「连接拒绝」「Token 无效」等。

解决步骤:

检查WebUI访问凭证(Token)

未授权大概率是Token错误或缺失:重新在终端执行「openclaw dashboard –no-open」获取Token命令,复制完整带Token的URL复制到网关令牌,成功后右上角版本和健康状态呈绿色。

若怀疑Token泄露,执行openclaw token reset重置Token后重新获取。

后续可扩展对接钉钉、飞书、Telegram、Notion、GitHub等,需简单配置/开发,无平台依赖时,WebUI是最基础、安全的使用方式,新手可优先掌握。

相关教程:

《阿里云轻量应用服务器本地部署OpenClaw并集成钉钉保姆级教程》

《Hostinger Linux VPS安装Docker并部署OpenClaw教程》

《DigitalOcean一键部署OpenClaw操作流程》

相关推荐:《支持快速部署OpenClaw的VPS云服务器商家整理》

(QQ扫码加入OpenClaw小龙虾交流群)

(QQ扫码加入OpenClaw小龙虾交流群)

(微信扫码加入OpenClaw小龙虾交流群)

(微信扫码加入OpenClaw小龙虾交流群)

立即加入腾讯频道【OpenClaw小龙虾交流群】:点击直达频道

(本文由美国主机侦探原创,转载请注明出处“美国主机侦探”和原文地址!)

微信扫码加好友进群

主机优惠码及时掌握

QQ群号:164393063

主机优惠发布与交流